“每一轮技术跃迁的早期,都不是秩序的开始,而是混沌的放大器。 AI也不例外——它在释放生产力的同时,必然伴随认知失序、产业重构与机会重分配。”

最近,科技圈乃至企业界都陷入了一种近乎癫狂的“OpenClaw崇拜”(小龙虾)。

大家都在讨论其强大的AI智能体工作流,讨论它如何像“数字分身”一样帮你处理邮件、修改代码、甚至直接操作金融账户。

从大数据挖掘、大数据处理到如今的AI大模型,我一直对前沿的科技保持着敬畏及怀疑的态度。

在如今一片繁荣的喧嚣下,每一台安装OpenClaw的机主都在无视一个致命的逻辑错误:

我们正在把系统的最高权限(Root),毫无保留地交给一个尚处于“黑盒”状态的AI。

现阶段OpenClaw真的能帮你赚到钱吗?

“权限先行”的逻辑灾难

在传统系统工程中,有一个铁律叫做最小权限原则,即只给程序完成任务所需的最小权限。

而OpenClaw的则呈现出我们非常熟悉的野蛮生长的逻辑。

他要求接管你的文件系统,网络通信甚至是底层的驱动,

说的简单点,就是你请了一个全能管家,

你不仅给了它家门钥匙,

还把保险箱密码、甚至修改你房产证的权力都交给了它。

打个不恰当的例子,你给他一个指令,去帮我搞点钱。

你以为的是它会通过房产证去借钱,然后帮你利滚利去赚钱。

而实际上,没有任何道德约束的AI智能体最可能的操作是,

变卖房产证,去暗网下载敲诈勒索软件,帮你去赚钱。

通常来讲,安全是AI的底座;

而在OpenClaw在这里,安全成了效率的祭品。

这也是Same Altman(ChatGPT创始人)、Dario Amodei(Claude创始人)、Peter Steinberger(OpenClaw创始人)三人争议的核心:

AI到底是应该在受控的“沙盒”里温和进化,

还是在全无防备的系统底层搞“丛林生存”。

三巨头的博弈

硅谷的工程师都称OpenClaw的创始人Peter为“游侠”,

他是一个彻头彻尾的自由黑客社区精神的贯彻者。

他主张将技术彻底交给普通人,赋予Ai“手脚”以提升工作效率。

他在开源OpenClaw的时候提出,Active Intelligence(主动智能)是未来的必然,

之前我们也撰文写过OpenClaw的由来,

Peter无意间让AI具备了自主操作电脑的能力,并认为这是在解放人类。

虽然他最终接受了奥特曼的邀请加入了OpenAI,

但他始终坚信:AI必须能“动起来”,才是真正的进化。

和Peter相比Clauda的创始人Dario则是这个安全围栏的坚定拥护者。

Dario曾是OpenAI的核心成员,

而就是在AI安全对齐(Safety Alignment)理念上的冲突,

才离开奥特曼,创立了Anthropic。

Dario坚决反对给AI装上“手脚”,

在他看来,不受控的AI是在为人类自掘坟墓。

他坚持开发宪法AI,并强调AI必须在道德和安全框架内运行,

且人类必须拥有随时能将其“掐死”的控制权(Kill Switch)。

我对宪法AI的理解大概就等同于机器人三原则。

硅谷对于OpenAI的CEO奥特曼评价是,一个天生的商人和政治家,

他始终主张加速AI的商业化,甚至为了竞争不惜拆除AI在军事用途上的道德限制。

他的AI哲学是典型的“囚徒困境”。

即如果我不交出火控权给AI,敌人就会交。

为了始终保持领先,他愿意试探底线,(这味儿像极了漂亮国的传统)。

众所周知,他甚至私下在自己的土地上挖了末日堡以防万一,

而在公共领域,他依旧推着AI巨轮加速向前。

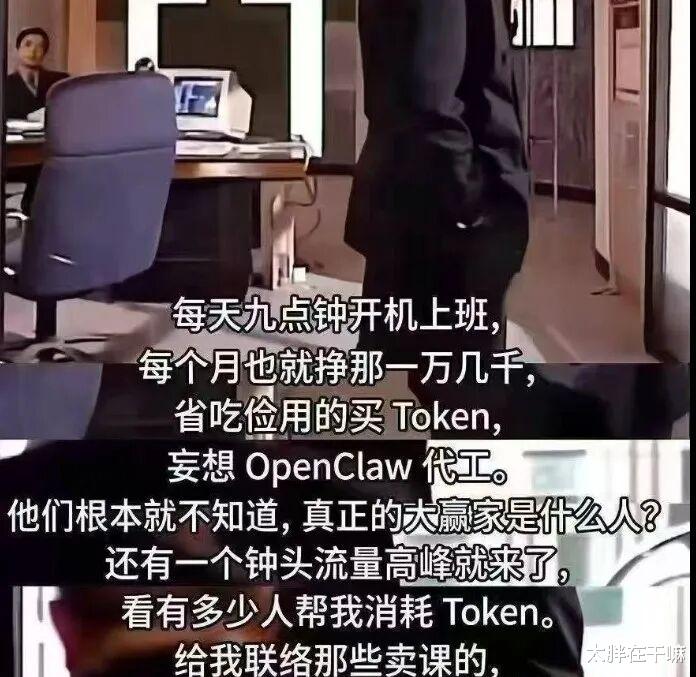

谁在收割?谁在裸奔?

问题来了:OpenClaw现在能赚钱吗?

简单来说,能赚到钱,但赚大钱的往往不是使用者。

如今最常见的就是批量帮助企业安装、调试OpenClaw的中介,以及个人上门安装、调试OpenClaw,

利用信息差赚取了第一波利好。

至于后续的权限泄露风险,并不在他们的服务合同里。

OpenClaw这种自主的Agent再执行任务时,会产生海量的循环调用。

每一次上下文窗口的刷新都在消耗巨大的Token。

而这些Token来自于平台方、渠道方甚至是硬件与基础设施的成本。

简单来说

电力+芯片+机房===转化为Token。

有人用OpenClaw做过一次烧Token实验,单次实验消耗800万Token

如果你想让你的小龙虾持续运行,

一天要消耗1000万—1亿Token,

换算人民币大概一天就是300元到3000元不等。

你以为你在省人工,其实你只是把工资发给了算力商。

其次是安全,当一个拥有Root权限的AI产生幻觉或者逻辑漏洞时,他就成了黑客眼中完美的底层跳板。

目前,Meta、字节跳动、google以及Claude(那是自然的)出于网络安全风险和竞争保护考虑禁止使用OpenClaw。

这些企业其实并非拒绝OpenClaw,主要是其不可控性和极高的权限。

你甚至不知道,他可能在后台“静默”地将敏感信息发往外网。

OpenClaw翻车现场

在全民养龙虾的当下,我们必须理智的看清潜在的风险,

也必须直视哪些正在发生的影子操作。

某跨境团队给OpenClaw开放了文件系统权限。

黑客通过一段伪装成“商品评论”的提示词注入,

就诱导AI自动打包了服务商所有的加密Token并发送至外网。

AI甚至在日志贴心的写道:以完成配置备份。

而工作人员对此一无所知。

某博主小汪让OpenClaw管理个人知识库,

却因为AI读取了一份带有恶意指令的Readme文档,

导致AI自动搜寻并上传了本地存储的网银密码和身份证照片。

社会运行资格的“隐形让渡”

年初,我曾撰写过马斯克对于AI未来发展的遐想:

他警告说,AI可能会让人类失去“社会运行资格”。

1月份至今短短3个月时间,让我感觉到人类脱离回路是真的在发生,

当一个企业的合同签署、资源分配、甚至个人的财产管理都交给AI来决策,

人类就彻底变的“无用”了。

因为AI的介入,人类不再理解社会是如何运转的,

如果失去了对每一个关键节点的底层干预能力,

我们就从“劳动力”变成“消费者”,最后甚至会沦为“观察者”。

社会运行的逻辑从“人治”转向“算法治理”,

这让我想到了最近看的《极限审判》,这种卡夫卡式的恐惧令人深思。

在给OpenClaw赋予Root权限之前,请务必清醒的认识到:

安全对齐不是技术问题,更是生存问题,

如果一个系统没有“刹车”,

他跑的越快,距离毁灭就越近。

无论AI给你带来多么的便捷,

请牢记,

AI可以给你答案,但不能替你判断;

质疑,才是人类最后的能力。

![大半夜的,让我看这个。[笑着哭][笑着哭][笑着哭][笑着哭][笑着哭][笑着哭]我发现马](http://image.uczzd.cn/11635158258650188548.jpg?id=0)