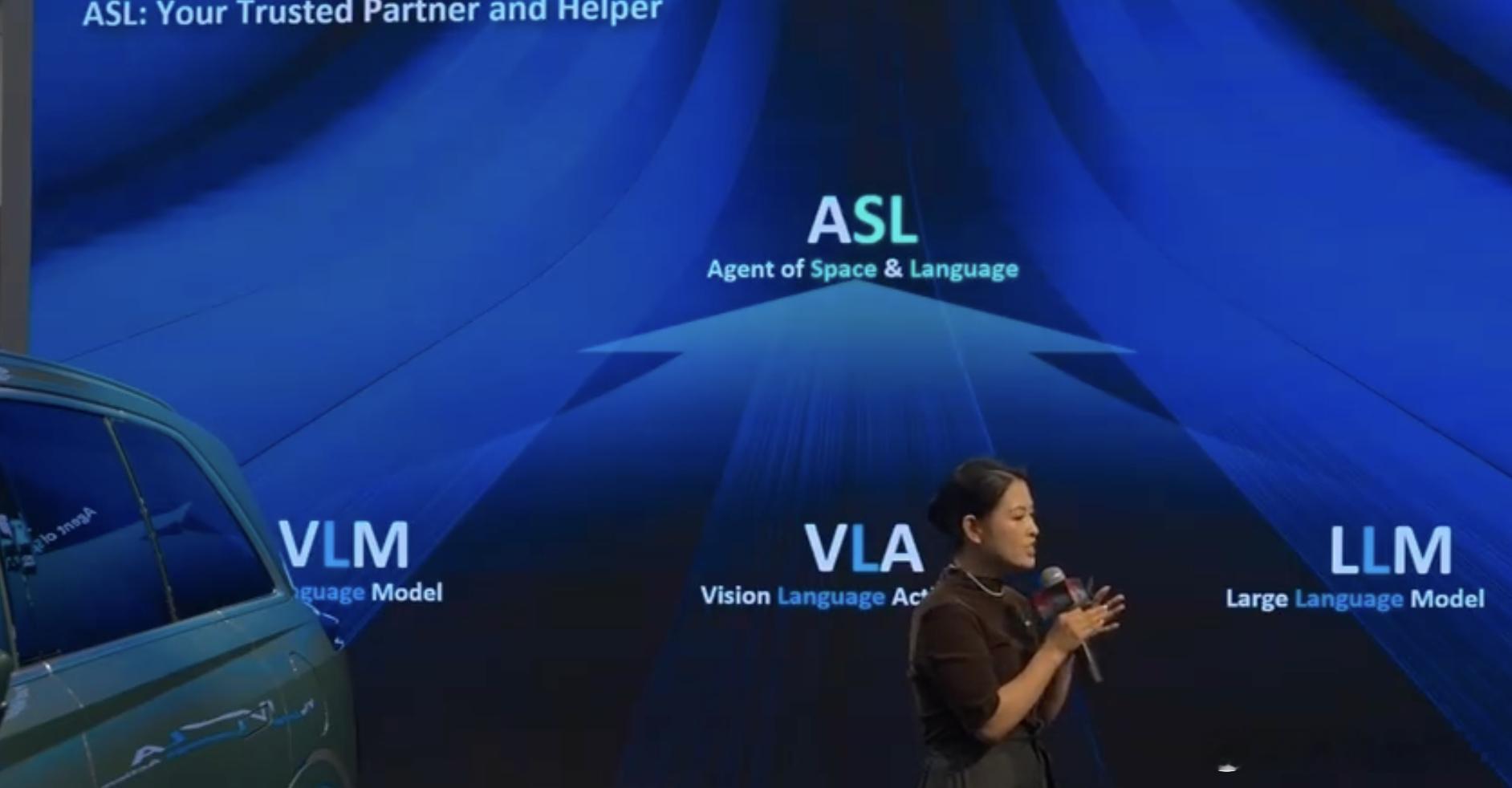

长城在CES上公布了ASL大模型(Agent of Space & Language),一种 智能座舱+智能驾驶 的AI模型。

这个ASL模型 融合 3D环境感知 与 人类语言交互 ,能够将 视觉、听觉、语言 等多维度的信息统一处理,来实现主动决策和针对驾驶员的个性化服务。

举个例子,目前很多AI底盘,能够通过外界的传感器,对路面信息进行实时的扫描,来做出更好地车身调整。

而ASL的使用环境则是,大模型感知到座舱内有老人,可以对加减速进行调整。

个人猜测,ASL大模型 应该是通过 车内摄像头、车内语音 对座舱的环境、人员进行感知,在搭配上 驾驶员的车机使用习惯和驾驶习惯,综合 车外的环境 进行实时地调整,来达到 适应用户的主动决策 和 驾驶员的个性化服务。

具体的实现和实车体验,目前还没有更多信息。