2025年11月3日,美团LongCat团队正式发布并开源全模态大语言模型LongCat-Flash-Omni,标志着开源领域迎来“全模态覆盖、端到端架构、大参数量高效推理”一体化的突破性产品,为实时多模态交互应用提供了新范式。

该模型以LongCat-Flash系列的Shortcut-Connected MoE高效架构为基础,创新性集成多模态感知与语音重建模块。在5600亿总参数(激活参数270亿)的规模下,实现毫秒级响应,支持128K tokens上下文窗口与超8分钟音视频交互,破解了大参数模型推理延迟的行业痛点。其采用渐进式早期多模融合训练策略,分六阶段逐步融入文本、音频、图像、视频等模态,确保全模态性能强劲且无单模态能力退化。

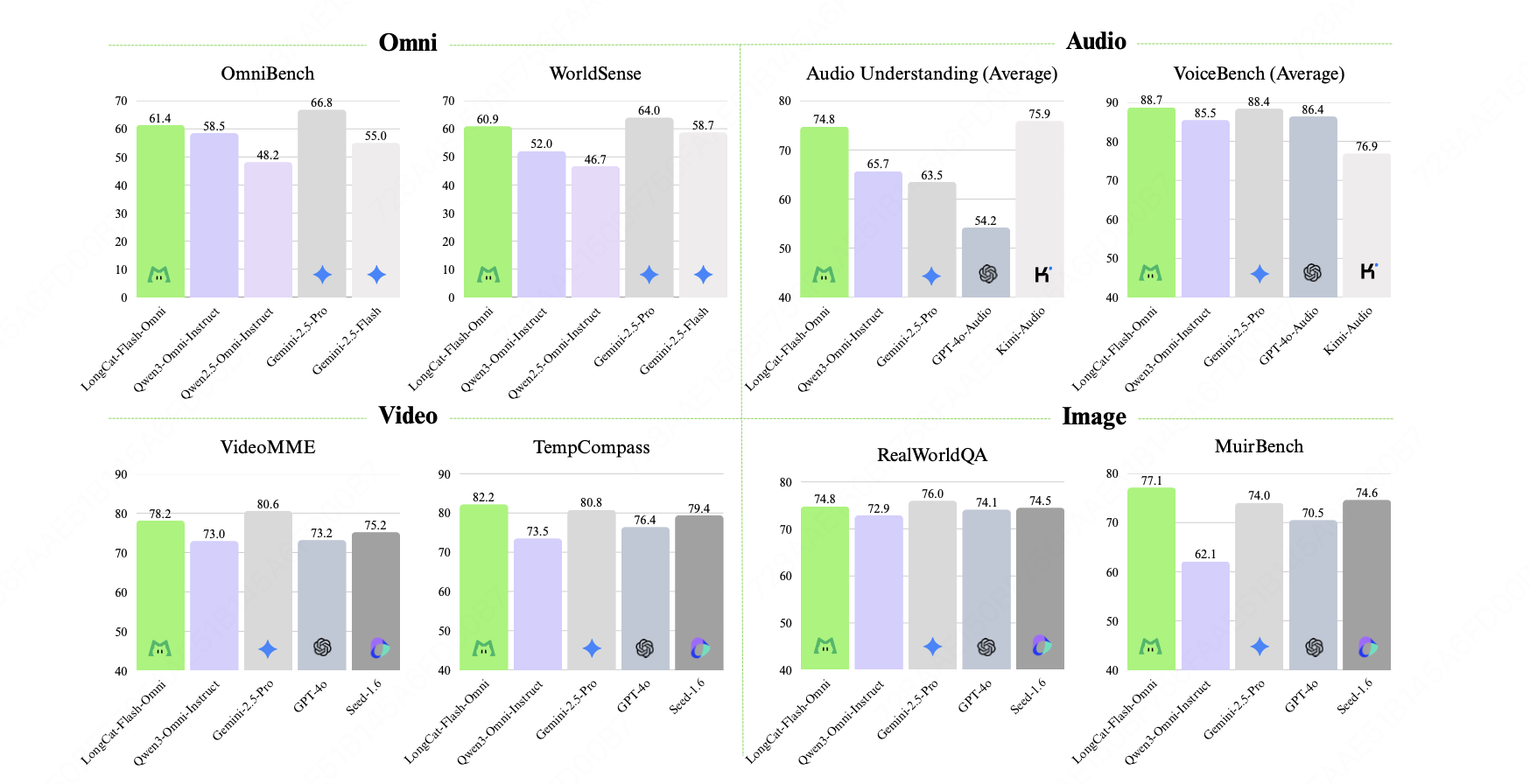

综合评估显示,该模型在Omni-Bench等全模态基准测试中达到开源SOTA水平,文本、图像、音频、视频等单模态任务均位居开源前列。其中音频理解与语音交互类人性指标优于GPT-4o,视频到文本任务性能当前最优,跨模态理解比肩Gemini-2.5-Pro。 目前,LongCat-Flash-Omni已在Hugging Face与Github同步开源,官方App也开启公测,支持联网搜索与语音通话功能。开发者可通过开源平台探索应用,美团也期待通过社区反馈持续优化模型性能。