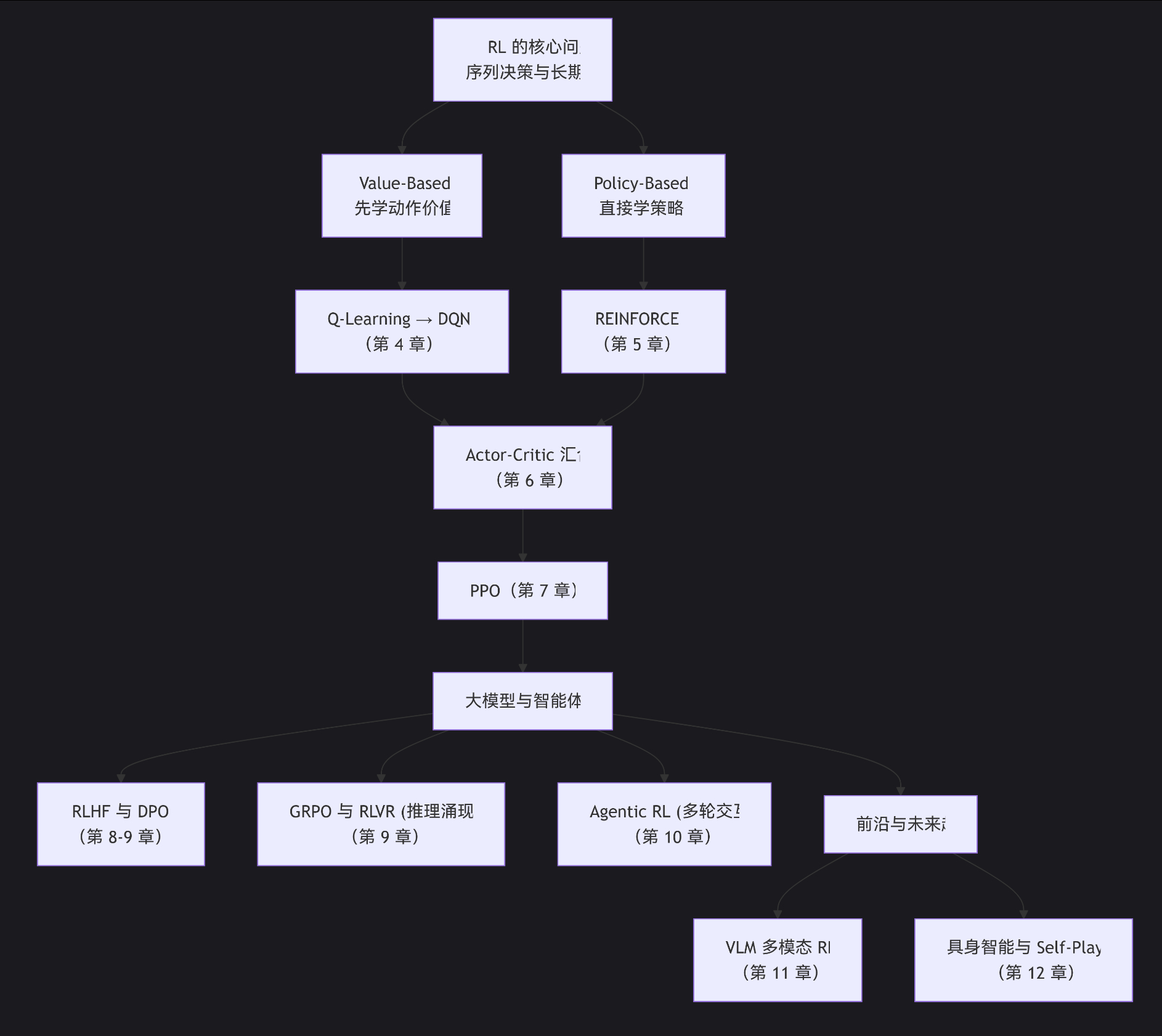

强化学习教程:Hands-On Modern RL,现代强化学习实战指南:涵盖经典控制、LLM 后训练、RLVR 与多模态智能体在线阅读:walkinglabs.github.io/hands-on-modern-rl/书籍仓库:github.com/walkinglabs/hands-on-modern-rl

2016 年,AlphaGo 击败李世石,强化学习第一次震撼公众。2022 年 ChatGPT 发布,人们发现 RL 正是让大语言模型从"能说话"变成"说好话"的关键技术。从 DeepSeek-R1 到各类开源对齐模型,RLHF、DPO、GRPO 等算法已经深刻地重塑了整个 AI 行业。

然而,市面上的学习资源严重滞后于行业实践。主流教程对 RL 一笔带过,专门的 RL 教材又停留在传统框架,对 PPO、DPO、GRPO 只字不提。一个想要理解 RLHF 流程的工程师,不得不在经典教材和最新论文之间艰难地自行搭建桥梁。我们着手写这本书,就是为了填补这道鸿沟。

这本书代表了我们的尝试——让现代强化学习变得平易近人,用代码、数学和直觉的融合来教会人们核心概念。

一种"先动手、后理论"的学习路径

许多教科书先讲完 MDP 的全部性质,再讲贝尔曼方程,最后才允许你碰一行代码。在这本书中,你将从第一章的第一行代码开始训练一个智能体。当你亲眼看到 CartPole 的小车从摇摇晃晃到稳稳站立,亲手用 DPO 让一个大模型学会"说好话",再回过头理解背后的数学时,学习过程会更加自然,理解也会更加持久。

每一章都遵循一个四步循环:先给你一段可运行的代码,让你获得直接经验;然后引导你关注训练曲线上的关键现象;接着在具备直觉的基础上讲解数学原理;最后用理论重新解读之前的现象,完成从直觉到形式化的闭环。

本书的每一章都包含可运行的代码示例。强化学习中的许多直觉只能通过试错来建立——调一调学习率,观察 reward 曲线的振荡;改一改 clip 参数,看看策略是否会崩溃。这些经验无法仅靠阅读公式来获得。

本书面向学生、工程师和研究人员。不需要过往的深度学习或机器学习背景,只需基本的 Python 编程能力、线性代数(矩阵运算)、微积分(偏导数、链式法则)和概率论基础(期望、条件概率)。大多数时候,我们会优先考虑直觉和想法,而不是数学的严谨性。AI创造营How I AI