[LG]《PolyKV: A Shared Asymmetrically-Compressed KV Cache Pool for Multi-Agent LLM Inference》I Patel, I Joshi (2026)

在多智能体推理中,KV缓存随代理数线性膨胀是悬而未决的难题。过去方法受困于“每个agent一份缓存”或仅做压缩,本质原因是共享与压缩被分开处理。

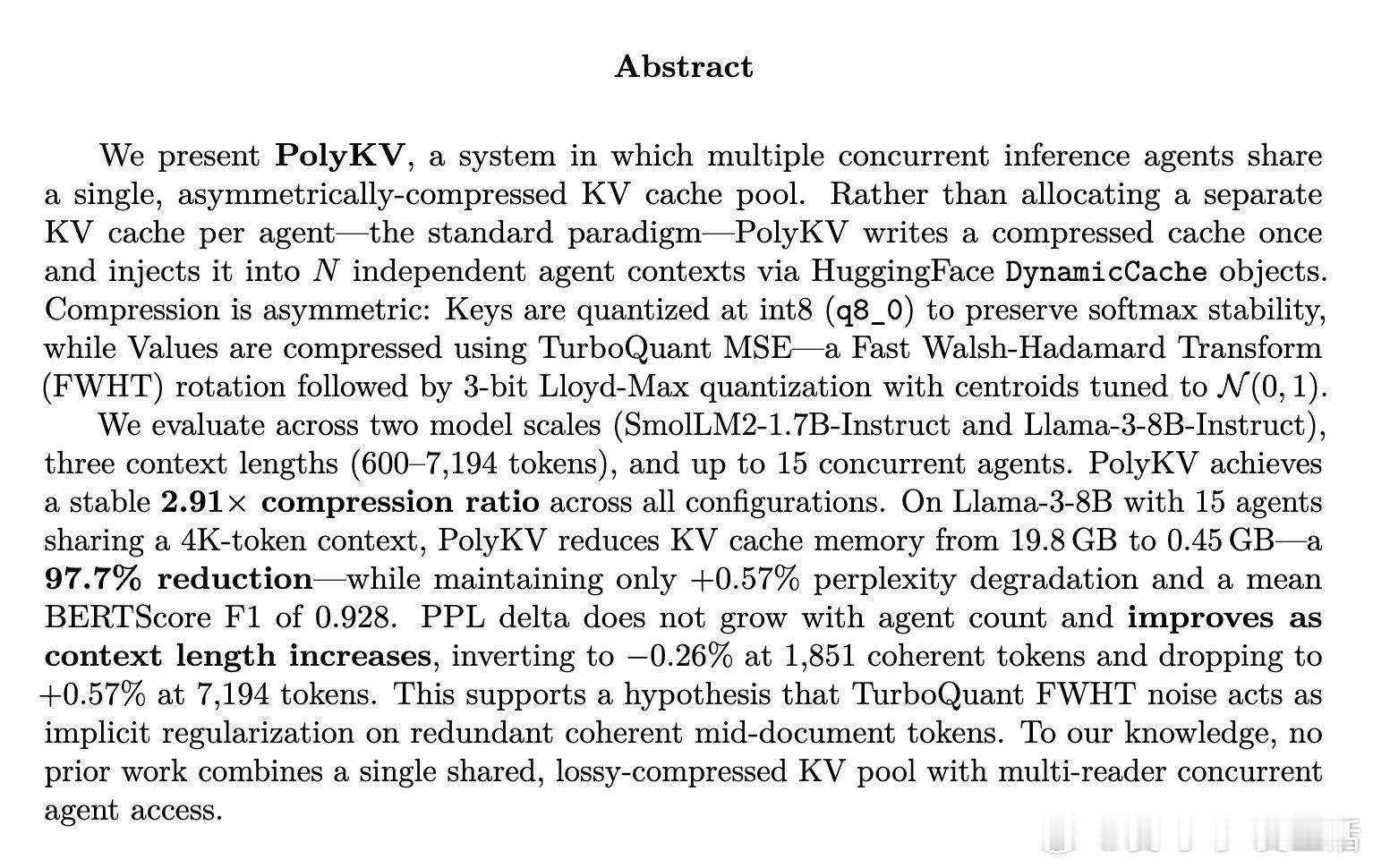

本文的核心洞见是:把KV缓存重新看作“可被多读的共享资源”。由此,先压缩一次再注入多个agent,使内存从随N增长变为常数级。

这项工作真正留下的遗产是共享压缩KV池这一新范式。它为高并发推理打开低内存运行之门,但尚未跨过大模型与延迟指标验证的门槛。

arxiv.org/abs/2604.24971 机器学习 人工智能 论文 AI创造营