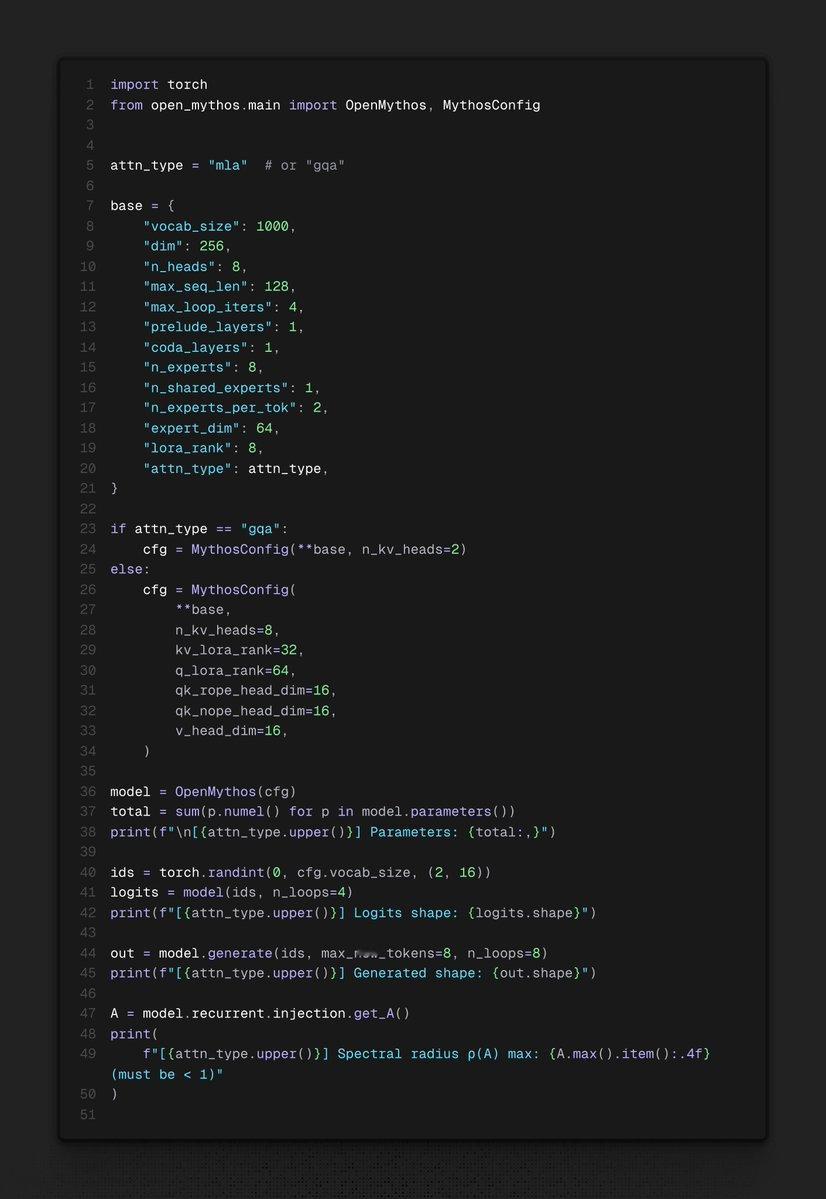

OpenMythos 是一个开源项目,基于第一性原理对 Claude Mythos 进行理论重构,并使用 PyTorch 实现。地址:github.com/kyegomez/OpenMythos

以下为项目开发者Kye Gomez的介绍:

该架构实现了一个循环式 Transformer,并引入 Mixture-of-Experts(MoE,专家混合)路由机制。通过权重共享和跨专家的条件计算,它能够在迭代过程中获得更深的有效计算深度。

我的实现探索这样一个假设:递归应用一个固定参数化模块,并结合稀疏专家激活,可以带来更优的效率—性能权衡,并涌现出多步推理能力。

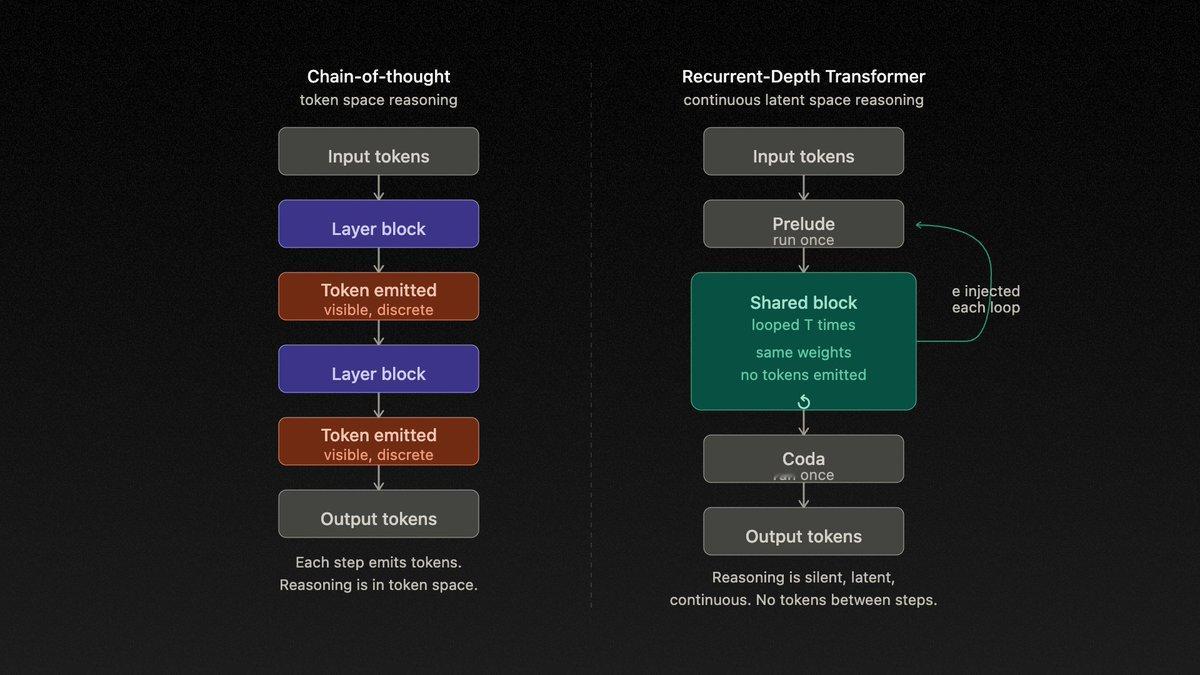

我假设 Mythos 是一种 Recurrent-Depth Transformer(RDT,递归深度 Transformer):这是一类循环式 Transformer,在一次前向传播中,会在 T 个循环步骤内反复应用同一组固定权重。

关键在于,推理完全发生在连续潜在空间中。各步骤之间没有中间 token 输出。这种结构与 chain-of-thought(思维链)不同,并已在相关研究中得到形式化分析(Saunshi 等,2025;COCONUT,2024)。

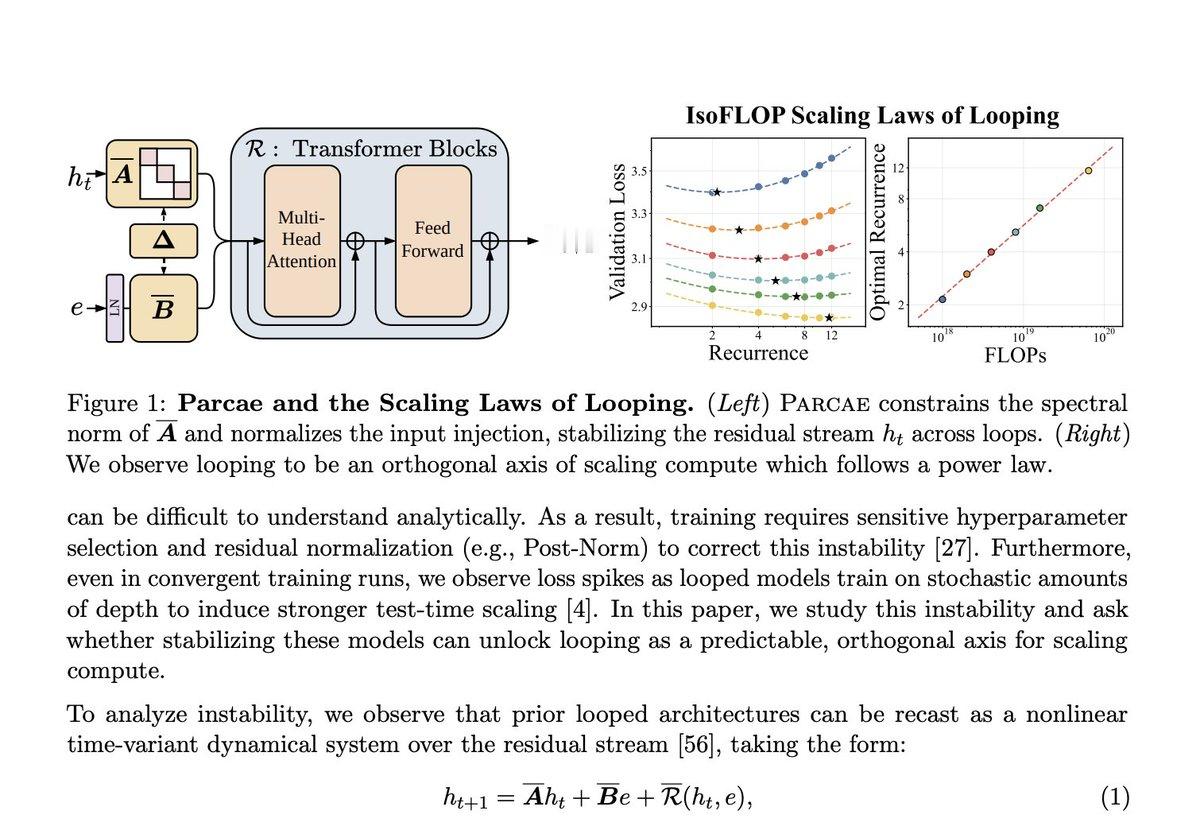

递归模块最多执行 T=16 次循环迭代,每次迭代都运行同一个共享的 TransformerBlock。在每一步中,冻结的编码输入 e 会通过稳定的 LTI 更新规则重新注入:

h_{t+1} = A·h_t + B·e + Transformer(h_t, e)

该模块中的 FFN 是一个 Mixture-of-Experts 层,遵循 DeepSeekMoE 的设计:一个由细粒度路由专家构成的大型专家池,每个 token 只激活稀疏的 top-K 专家子集;同时还包含一小组始终激活的共享专家,用于吸收常见的跨领域模式。

关键点在于,路由器会在每一层循环深度选择不同的专家子集。因此,每次迭代都是一次计算路径不同的前向处理。MoE 提供领域广度,循环提供推理深度。

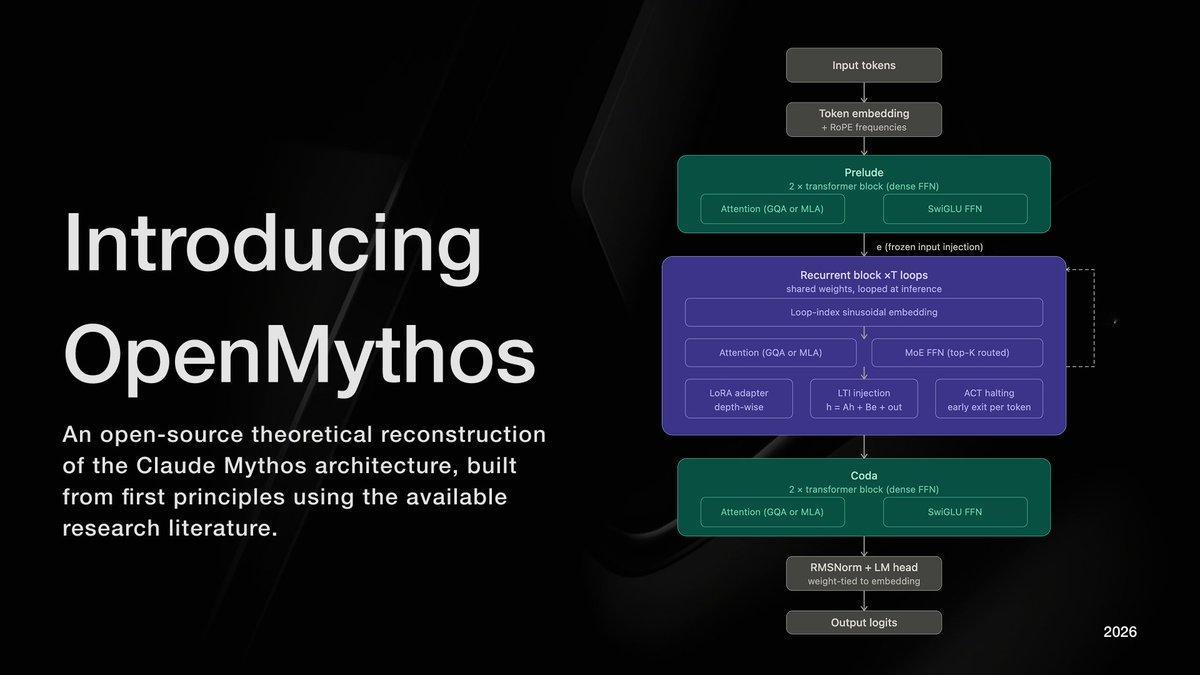

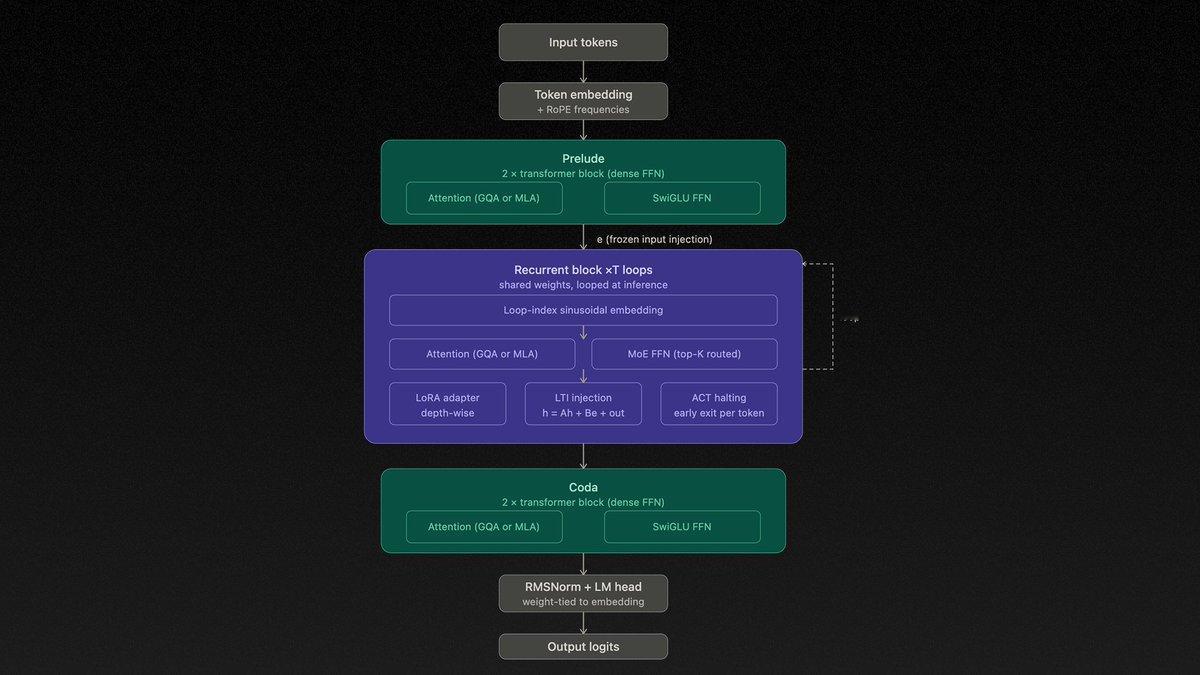

完整架构如下:

Prelude → Recurrent Block → Coda

Prelude 和 Coda 是标准 Transformer 层,各自只运行一次。Recurrent Block 是计算核心。注意力机制默认采用 Multi-Latent Attention(DeepSeek-V2),缓存的是压缩后的低秩 KV 潜变量,而非完整 K/V 张量,从而在生产规模下实现 10–20 倍的 KV 内存降低。

还有三项机制用于稳定循环过程:

1. LTI 约束注入,构造上满足 ρ(A) < 12. 按位置自适应计算时间终止机制3. Depth-Wise LoRA 适配器,用于增强每次迭代的表达能力

在参数效率方面,一个包含 k 层并循环运行 L 次的模型,可以用 k 层参数达到 kL 层标准 Transformer 的质量水平。

实证结果显示(Parcae,Prairie 等,2026):在 7.7 亿参数规模下,RDT 在相同训练数据上可以匹配 13 亿参数标准模型的表现。推理深度由推理时计算量决定,而由存储参数量决定的程度较低。

这重新定义了扩展问题中的关键轴线:重点是推理时的循环深度,而非训练时的模型规模。

OpenMythos 的贡献包括:

1. 一个完全开放、可配置的 PyTorch 实现,用于验证带有 MoE FFN 和 Multi-Latent Attention 的 RDT 假设2. 将 LTI 稳定递归注入(Parcae)集成为一等训练原语3. Depth-wise LoRA 适配器,在几乎不增加额外参数开销的情况下,实现每次迭代的行为差异化4. 一个可复现的研究基线,用于研究循环式 Transformer 动力学、扩展行为和推理时深度

这是一个开放研究项目。我们欢迎围绕训练稳定性、扩展实验、循环深度分析和替代注意力机制的贡献。

AI创造营