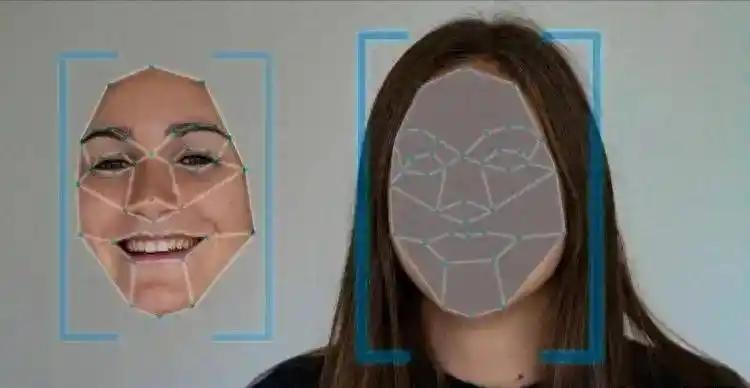

10分钟被骗430万!AI诈骗在全国爆发,这三种“套路”要多加小心 2023年4月,福建郭老板正在工作,忽然收到好友微信视频通话,郭老板接起电话后,“好友”在视频中称自己正在外地竞标,急需430万保证金,想借用郭老板公司账户走账。郭老板想着自己“好友”都已经在微信视频上和自己说了,不便推辞,就在10分钟内把430万转到“好友”提供的银行账户里。事后郭先生拨打好友电话得知受骗!430万打了水漂! 是你的话,你会怎么做?你的朋友已经给你打了微信视频电话,视频电话中对方的长相是对的,声音是对的,要求甚至也是合理的,如果这类电话将来打给你了,你会怎么做才不至于受骗? 事实上,AI不仅为我们的生活及工作带来了很大的便利,但与此同时,也被不法分子通过科技手段很好伪装成我们“认识的人”在全国范围内进行诈骗活动的案例也是屡见不鲜。 在此,我们总结了通过AI工具进行诈骗的三种“套路”,提醒以后在遇到时要多加小心; AI换脸诈骗 也就是上面福建郭老板遇到的诈骗方式,原来骗子利用AI换脸和拟声技术,骗取了郭老板的430万元。 该种诈骗方式的原理就是骗子通过AI工具为自己“换脸”,这张脸可以是你的朋友,以及你可以想象的到或者想象不到的任何人,以此来让你对对方的身份深信不疑。外加上拟声技术,让你视频对话中的“朋友”的身份在此确认,让你深信不疑。 而对制AI换脸诈骗的方法其实是不难的,首先要提高防骗意识,无论与任何人沟通,一旦涉及对方要求提供身份信息、或者其他私密信息、尤其是有转账要求的时候马上要提高警惕;其次,在提高警惕时要深入观察对方的画面中的表情是否自然,脸型是否变形等细节;或者干脆不辨识脸型,而通过多种方式对对方的身份信息进行验证,尤其是问一些只有对方才知道的问题,以验证真实性; AI假名人诈骗 这也是另外一种的诈骗方式,近期网络上流传多起AI声称的假名人视频,例如假张文宏、假靳东等。骗子利用名人效应,制造假名人视频,诱导受众进行投资或提供个人信息。 而对待这种方式,就首先提高警惕,试想哪有那么多名人无缘无故的给自己打电话,打电话还不要紧,还索要私人信息。 不要提供!不要提供!不要提供!重要的事情说三遍。 首先要做的就是直接关掉视频,就当没看见,必要的时候可以通过公安机关核查确认; AI语音合成诈骗 骗子利用AI技术模拟亲朋好友高度逼真的声音,以紧急情况为借口,要求你进行转账。借口五花八门,比如说“急需手术费”“被绑架了急需打钱”“出门在外急需垫资”等等,诱导你转账。 对制这种诈骗方式首先要求保持冷静,不要在慌乱中下决定,其次收到紧急电话后,通过其他方式与对方多次核实确认情况。 当今AI的技术发展迅猛,不知道明天会出现一个什么AI技术出来,但是一切的诈骗必然归结于要求直接转账或者间接要你的个人信息最终通过其他方式骗钱。 除了国家的立法开始对AI的用途进行制约外,我们一定要提高警惕,对一切需要转款的需求,保持冷静、多方确认、多方观察,必要时寻求警方帮助。只要做到这四点,不论骗子有多么高超的骗术技巧,我们都可以避免损失。 关于AI诈骗事宜,屏幕前的你有什么想说的,欢迎留言讨论!