3月16日,智谱扔出一份“涨价函”:推出全球首个面向OpenClaw场景的基座模型GLM-5-Turbo,API价格同步上调20%。

这不是孤立事件。今年2月,智谱GLM-5已平均涨价50%,两轮下来相对GLM-4.7累计涨幅达83%。腾讯云紧随其后,混元系列模型部分涨幅超400%,GLM 5、MiniMax 2.5、Kimi 2.5结束免费公测。

大洋彼岸,AWS将EC2价格上调约15%,谷歌云宣布5月1日起全球数据传输服务价格翻倍。

从西雅图到北京,云厂商们在同一时间窗口集体涨价,打破了一个持续近二十年的行业信仰:云服务只降价,不涨价。

这是一次周期性修复,还是AI免费时代的终局信号?

智谱官方解释涨价原因时提到:“为保障高负载下的稳定性与服务质量,同步加大算力与模型优化投入。”优刻得说得更直白:“核心硬件采购等基础设施成本出现显著且结构性的上涨。”

表面看是供需错配:企业将客服系统、核心业务流接入大模型,个人用户开始用Agent处理复杂任务,Token消耗量从涓涓细流变成海啸爆发。但更深层的变化是——算力成本正在经历结构性抬升。

国金证券研报指出,2026年将是中国算力需求从“云端训练”向“训练+推理”双轮驱动转型的关键之年。训练侧向高质量与多模态进阶,Scaling-law在多模态领域延续性显著,视频、音频及3D训练对集群互联带宽提出更高要求。

推理侧应用加速渗透,豆包APP 2025年12月MAU已突破2.26亿,推理侧需求将成为拉动产业链增长的新引擎。

但真正的问题在于供给端。摩根士丹利一份深度报告揭示,生成式AI带来的爆炸性需求正驱动全球半导体产业链从“芯片设计竞赛”转向“物理产能争夺战”。先进制程、CoWoS封装、HBM内存、DDR5等关键环节预计在2025年底全面满载。

这意味着产业瓶颈已从“谁能设计出最好的芯片”变成“谁能拿到稳定的产能”。晶圆、封装、基板、电力、无尘室空间,都成了限制发展的“硬约束”。

不过更值得关注的是,这轮涨价并非短期现象。中芯国际2025年财报显示,公司在先进制程及成熟制程的扩产上均取得突破性进展,全年产能利用率稳步回升,资本开支维持高位以确保新增产能的及时释放。

大摩预测,2026年DRAM的bit需求将增长23%,供给缺口预计创下30年最大纪录。当“产能为王”成为行业新常态,算力成本的结构性抬升才刚刚开始。

国金证券预判,2026年算力产业链将进入“全链通胀”周期,行业景气度将从核心芯片向AIDC、云与算力服务、配套电力设备及服务器等环节全面外溢。

这是一条完整的通胀传导链:上游产能吃紧→芯片涨价→服务器成本上升→云服务商扛不住→API价格上调。

智能体爆发,Token消耗喷井式发展如果说算力通胀是供给侧的逻辑,那么需求侧的变化可能更加深远。

腾讯云此次涨价的背景是:OpenClaw(“龙虾”)全球爆火,一个月间Token消耗量翻4倍以上。

OpenRouter平台数据显示,OpenClaw的Token消耗量从2026年2月3日的806亿,在一个月内飙升至3月4日的3580亿,翻了约4.4倍。中国整体日均Token消耗于2025年中突破30万亿,2026年2月已到180万亿级别。

为什么Agent如此“吃”Token?因为它不是简单的一问一答。

当一个Agent被要求独立完成一项真实任务——分析竞品报告、审核合同、处理客户邮件,它会在后台反复推演逻辑,调用搜索引擎和数据库,甚至自我学习新技能再尝试。在这个过程中,每纠结一次、每调取一次工具,Token都在狂飙。根据Anthropic的数据,AI Agent的Token消耗量最高可达普通聊天交互的15倍。

国盛证券分析,由于Agent天然多工具调用+长上下文+多流程工作的特性,AI Agent的Token消耗量较大。随着智能体运行规模与任务复杂度的同步提升,活跃智能体的Token消耗进入高速增长期。根据IDC预测,中国活跃智能体数量将在2031年突破3.5亿,智能体Token消耗将迎来年均超30倍的指数级跃升。

这解释了为什么智谱此次涨价的焦点是新模型GLM-5-Turbo——它不是通用对话模型,而是专为OpenClaw等智能体任务“量身定制”。

智谱技术负责人分析,当下龙虾虽然火爆,但用户反馈显示,其运行并不通畅。在进入真实复杂的Agent场景后,通用大模型容易出现指令遵循偏差、工具调用不稳定、长任务中途失速等问题。

问题的根源不在框架,而在底层模型本身。从“对话”到“干活”,AI的使用范式正在根本性转变。这也意味着,Token的价值不再由问答次数决定,而是由AI替人干了多少活决定。

企业AI落地,从概念验证到价值创造的跨越当我们将视角从消费级应用转向企业级市场,会发现另一层更深的变化。

联想近日发布的《企业CIO行动指南(2026)》基于对中国620名政企机构IT和业务决策者的调研,揭示了一个关键洞察:企业正在从“+AI”阶段进入“AI+”阶段。

当前,越来越多的企业将AI从工具层推向销售、供应链、运营、服务等增值场景,AI正在直接参与价值创造。调研数据显示,67%的企业一把手在期待AI驱动主营增长。

但理想与现实之间存在巨大鸿沟。《指南》指出,目前企业对“企业超级智能体”的认知度达到61%,但真正认可其价值的企业比例仅为30%,明确表达出实际需求的企业更是只有13%。这一数据反映出,企业超级智能体在实际业务中的落地还处于早期探索阶段。

造成这一现象的主要原因在于,企业对企业超级智能体与实际业务间的关联度存在疑虑。许多企业认为企业超级智能体与自身业务场景的契合度不高,难以直接带来业务增量或流程优化。此外,对现有IT架构进行较大幅度的重构、法律责任与权限安全也是企业的顾虑所在。

更值得关注的是,企业的AI算力部署策略正在发生深刻变化。《指南》揭示,企业总AI算力中公有云的占比显著下降了14个百分点,而私有云、本地部署及端边侧算力的合计占比则从54%攀升至69%。

为什么?因为随着智能体深入处理企业核心业务数据,将敏感数据和关键算力部署在私有云或本地环境,成为降低数据泄露与合规风险的主流选择。

有调研显示,68%的企业CIO明确表示未来会更倾向于私有化部署或混合AI架构。这种混合部署模式,不仅提升了企业的算力利用率和业务韧性,也为智能体应用的规模化落地和创新发展提供了技术基础。

在算力基础设施建设方面,企业呈现出明显的“异构算力普及与平台采用存在鸿沟”的现象。有数据显示,异构算力的普及率已经高达85%,但算力管理调度与运维平台的采纳率却仅为32%。《指南》认为,企业亟需提升对算力管理调度平台的重视,只有实现异构算力的统一管理和智能调度,企业才能真正释放算力资源的最大价值。

商业模式重构,从Token付费到智能体结果付费的演进与企业AI落地进程相伴的,是商业模式的深刻变革。

传统的“一次性买断”或“按账号席位订阅”模式正在被重构,取而代之的是“基础订阅+按Token消耗收费”或“AI增值模块独立收费”的全新商业模型。

Gartner预测,到2026年底,40%的企业应用将集成任务特定的AI代理,较2025年的不足5%实现跨越式增长。到2035年,代理式AI将贡献超过4500亿美元的企业软件收入。

从目前来看,商业模式正从“大模型Token付费”向“智能体结果付费”演进。这一转变意味着,AI的价值衡量标准正在从“消耗了多少算力”转向“创造了多少价值”。

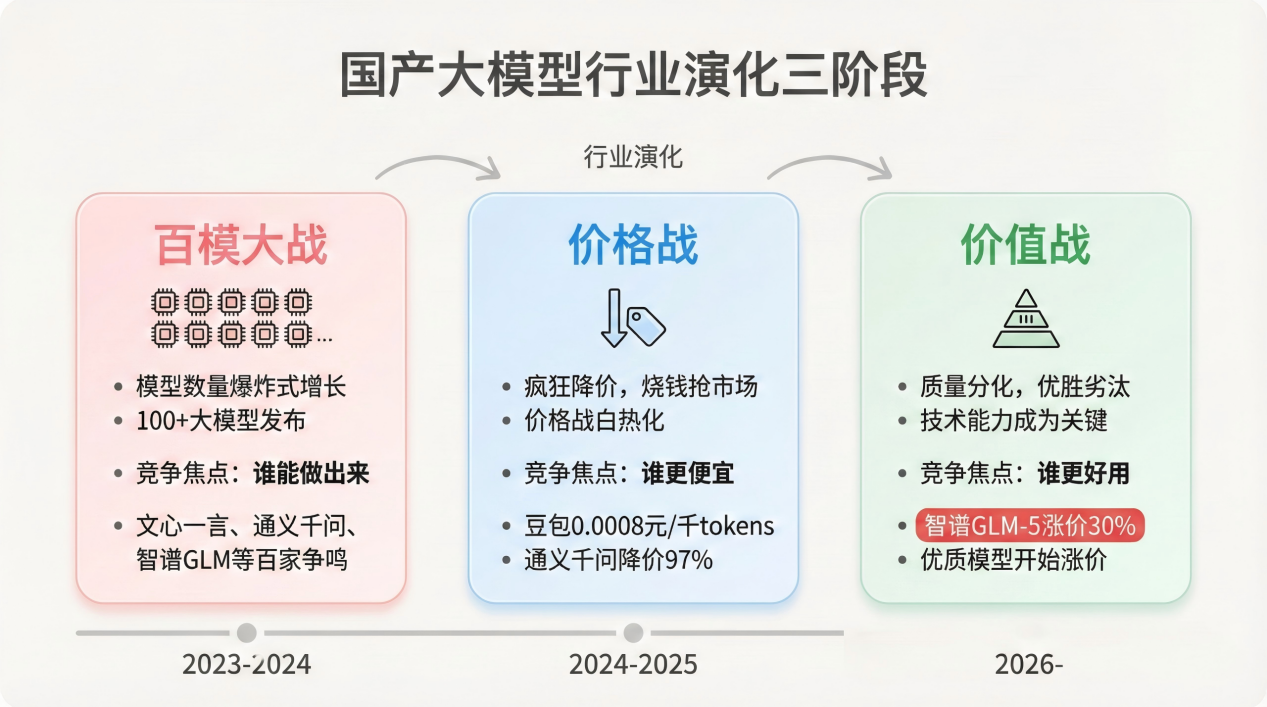

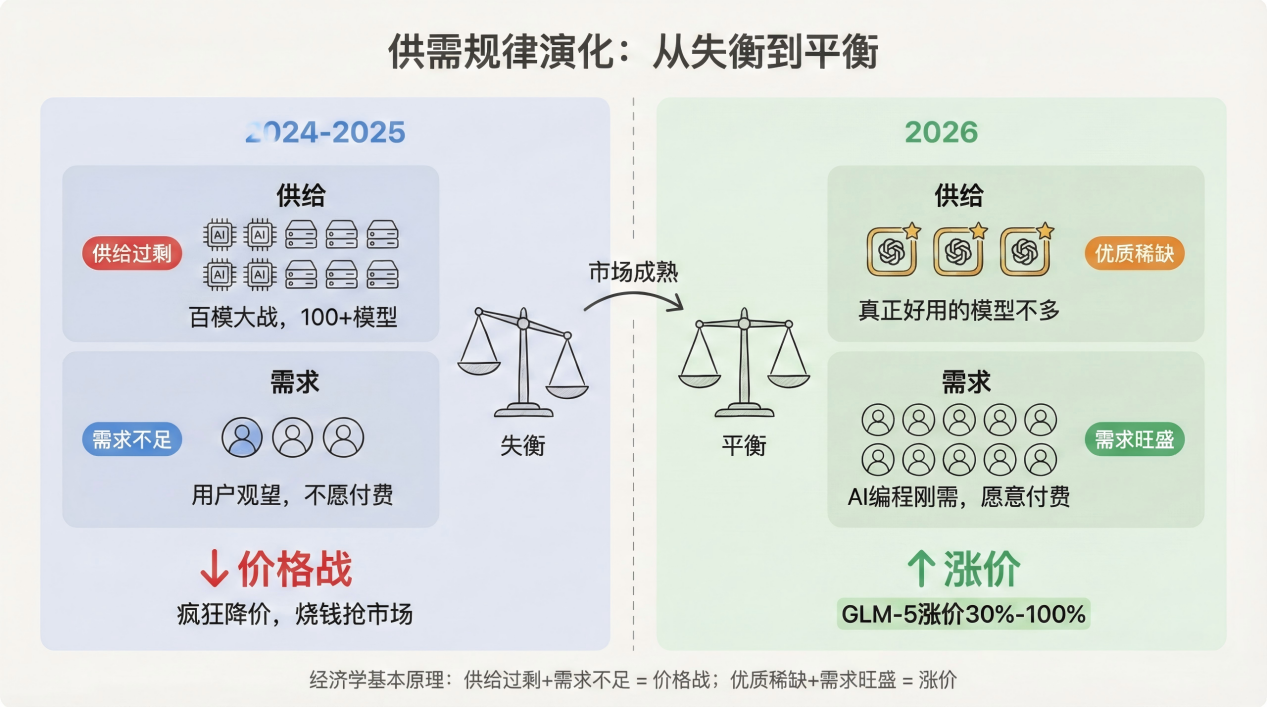

长江证券分析认为,国产模型已从“能力追赶期”迈入“需求爆发期”,模型能力提升→场景能力打开→需求提升→优质模式收入提升的正向大循环已经形成。

国内模型厂商正复刻2025年北美模型进入的“卖Token”时刻,伴随AI从写代码走向写工程,Token消耗量大幅提升,国内模型回归价值正轨。

从估值体系来看,软件开发板块本就具备极高的边际毛利率。在融入大模型能力后,软件企业只需承担相对固定的API调用成本,即可获得源源不断的增值订阅收入。这种“高毛利+持续性现金流”的财务特征,正在为相关算法公司与横向软件龙头提供极强的业绩支撑。

智谱此次推出的“龙虾套餐”正是这一趋势的体现。体验月卡39元获得3500万Tokens,进阶月卡99元获得1亿Tokens,这是继编程套餐后,国内首个专为龙虾场景打造的套餐。

这意味着,大模型API的客群正在从主攻编程的专业程序员,拓展到非程序员以及更多企业劳动力群体。这或许正是模型厂商向数字劳动力提供商转型的信号。

便宜的是单价,昂贵的是智能回到消费者最关心的问题:AI涨价了,普通人还用得起吗?

要回答这个问题,需要拆解“涨价”的真实含义。有文章深度分析指出,这次涨价很可能仅仅是旧硬件被新需求榨干时的一次短暂反弹。

现在的算力贵,是因为我们正处在一个硬件“青黄不接”的尴尬期。云端机房里很多跑推理的设备,其实是最初为了“训练”大模型而买的通用重型GPU,又贵又耗电。拿这种产品去处理日常海量的Token生成,成本自然全线崩塌。

但造芯片的巨头们可没闲着。天风国际分析师郭明錤最新研究指出,随着英伟达加大对AI推理架构公司Groq的投资布局,Groq旗下LPU出货规划出现显著上修。2026年至2027年期间,LPU累计出货量将达到约400万至500万颗,整体出货量将实现超过10倍的成长。

英伟达计划将单一AI机柜中的LPU配置数量,由目前的64颗大幅提升至256颗,新一代架构机柜预计将在2026年第四季度至2027年第一季度进入量产。这些新硬件砍掉了没用的计算单元,专攻数据的吞吐。在消耗同等电量的情况下,新机器产出Token的效率会呈指数级往上翻。

另外,华为昇腾、寒武纪、海光信息、昆仑芯等为代表的国产芯片厂商在单卡性能上加速追赶英伟达,华为旗舰已可对标H100,并通过超节点架构创新与英伟达机架级解决方案展开竞争。

随着国产芯片厂通过兼容CUDA及自研两种方式构建生态,逐渐突破CUDA生态壁垒,国产算力有望凭借成本优势及生态完善,在基础设施层逐步占据主导。

一旦底层的物理效率提上去了,单个Token的成本就会继续降低。所以从长期看,单个Token的单价不仅不会暴涨,反而会持续向“白菜价”俯冲。

但另一个趋势更加关键:当AI从“问答工具”进化为“Agent智能体”,完成同样任务消耗的Token量正在指数级增长。2023年用AI是一次对话消耗一两千个Token;2026年后,一个Agent独立完成一份竞品报告,可能在后台反复推演、多次调用工具,消耗的Token量是过去的几十上百倍。

所以,便宜的可能是单个Token的单价,昂贵的是我们赋予AI的任务复杂度。未来我们为AI付出的总账单,不是越来越便宜,而是取决于我们让AI干了多“重”的活。

Token已经开始分层定价——免费层的Token吸引用户;中等层每百万个3-6美元;高级层45美元;最顶级的研究型服务,每百万个能收到150美元。更值得注意的是,Token预算开始进入企业日常运营。黄仁勋提到,硅谷招人时,“这份工作附带多少Token额度”已经要写进offer里。

这意味着AI的商业闭环正在形成:从生产Token到消费Token,整条价值链已经跑起来了。

写在最后智谱的两次涨价,像投入湖面的石子,涟漪正在扩散。

对于AI企业,这意味着告别野蛮生长,回归商业本质。海通国际分析,与ChatGPT出现初期众多初创企业涌现相比,现时市场上的参与者根基稳固得多。更可预测的竞争环境将增加MiniMax及智谱持续蓬勃发展的机会,并有可能成为人工智能时代“终局”的一部分。

对于企业用户,这意味着需要从“试用者”转变为“价值投资者”。调研显示,63%的CIO计划未来招募AI行业专家。当“这份工作附带多少Token额度”成为offer里的条款,当AI从“工具”变成了“生产力”本身,企业需要真正思考如何让AI驱动主营增长。

对于个人用户,这意味着需要开始思考:AI帮我创造的价值,是否值得我付费?免费的午餐确实在结束,但这未必是坏事——只有能赚钱的行业,才能持续提供更好的服务。

至于最终账单是贵是便宜,取决于我们让AI干的活,是聊天解闷,还是创造真金白银的价值。