数据慢一步,决策就慢一步。

现在实时ETL被越来越频繁地提起,很多人搞不清实时 ETL 和传统

ETL的区别,也不知道该怎么搭建架构、选型工具。

今天我就从架构设计到工具选型,给大家讲清楚实时ETL到底怎么做?

开始之前,给大家分享一份数字化全流程资料包,里面覆盖了从 0-1 数据建设、数字化转型、BI 项目落地、指标体系搭建到数字人才培养的全链路干货,还有行业报告、精品案例、知识图谱和四大行业指标体系,帮助企业推进数字化转型。

一、实时ETL和传统ETL有什么不同ETL是三个英文单词的缩写:Extract(提取)、Transform(转换)、Load(加载)。

说白了,就是把数据从一个地方取出来,处理一下,再放到另一个地方去。

传统ETL是批处理模式。你设一个定时任务,比如每天凌晨两点跑一次,把昨天的数据全量处理完,写进数据仓库。这套逻辑简单,稳定,但有一个致命问题,数据是滞后的。你早上九点看到的数据,反映的是昨天的情况。

实时ETL要解决的,就是这个滞后问题。它的目标是让数据从产生到可查询,延迟控制在秒级甚至毫秒级。

二、实时ETL的整体架构是什么样的我一直强调,做技术方案之前,先把架构图在脑子里画清楚。实时ETL的全链路,从上到下分四层。

第一层:数据源层

数据从哪里来?最常见的是业务数据库,比如MySQL、PostgreSQL,还有应用日志、消息系统、第三方API接口,以及IoT设备上报的传感器数据。

这一层你不需要改造,但你需要知道数据是以什么形式产生的,是结构化的还是半结构化的,变化频率有多高。

第二层:采集与传输层

数据产生之后,怎么实时传出来?这里有两种主要方式。

CDC,也就是变更数据捕获。它的原理是监听数据库的操作日志,比如MySQL的Binlog,把每一条增删改操作实时捕获出来,转成事件流。这种方式对业务系统完全无侵入,不需要改一行业务代码。常用工具是Debezium和Canal。

日志采集。应用程序产生的日志文件,通过Filebeat这类轻量级采集器,实时传输到下游。

采集到的数据,需要一个高吞吐的消息队列来承接,这就是Kafka的位置。Kafka在这里起到缓冲和解耦的作用,上游数据源和下游计算引擎之间不直接通信,都通过Kafka中转。

第三层:计算与转换层

这是实时ETL最核心的部分。数据从Kafka里出来之后,需要做清洗、过滤、格式转换、字段补全、聚合计算等一系列操作,然后再写出去。

这个环节主要是流处理引擎,目前业界用得最多的是Apache Flink。为什么是Flink?因为它的延迟可以做到毫秒级,状态管理能力强,而且支持Exactly-Once语义,也就是说每条数据保证且仅处理一次,不会丢,也不会重复。

第四层:存储层

处理完的数据写到哪里?这取决于你的查询需求。

如果要做实时聚合分析,ClickHouse和Apache Doris是目前最主流的选择,查询速度快,支持高并发。

如果要做点查,比如根据用户ID查某个字段,HBase或者Redis更合适。

如果你们有数据湖的规划,Delta Lake和Apache Iceberg是流行的选择,它们支持批流统一写入。

三、工具选型怎么做市面上的实时 ETL 工具,大体分两类:一类是专业组件,性能天花板高但需要自己拼装;另一类是一站式平台,开箱即用但灵活度有所取舍。

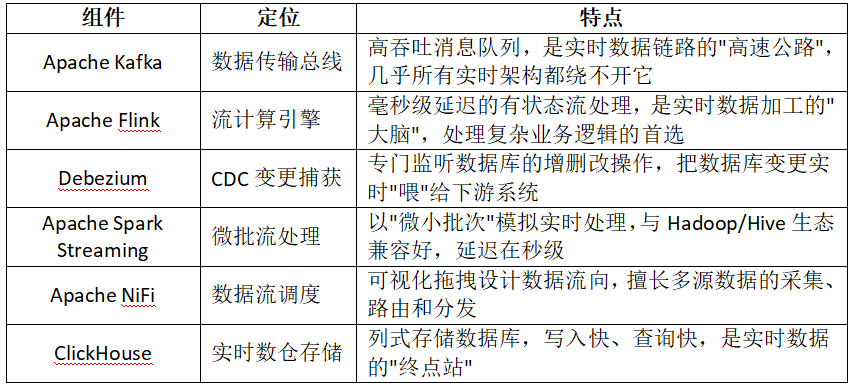

1、专业组件类(需搭配使用)

2、一站式实时ETL工具

(1)FineDataLink

国产一站式数据集成与治理平台,深度适配国内企业环境

核心功能

实时数据同步:支持CDC增量同步,数据库变更秒级同步到目标端

离线+实时一体:同一平台同时支持批量调度和实时流处理,无需切换工具

可视化流程设计:拖拽式配置数据管道,无需写代码

数据治理内置:自带数据血缘分析、元数据管理、数据质量监控

广泛数据源支持:支持100+数据源,涵盖主流数据库、ERP(金蝶/用友)、OA、API等

优点

与帆软FineBI/FineReport深度集成,数据集成到分析一站打通

中文界面、本地化服务好,上手快,适合非技术背景人员

支持私有化部署,满足数据安全合规要求

缺点

超大规模数据量(百亿级)场景下性能有天花板

定制化开发灵活度需要专门的技术团队

(2)Talend

国际老牌开源+商业混合数据集成平台,云原生能力持续增强

核心功能

丰富连接器:内置900+预置连接器,覆盖数据库、云服务、SaaS应用

实时流处理:支持与Kafka、Spark集成,实现流批一体处理

数据质量管理:内置数据清洗、去重、标准化模块

云原生部署:支持AWS、Azure、GCP等主流云平台,弹性扩展

开放扩展:支持自定义组件和插件,开发者社区活跃

优点

开源版本免费,社区资源丰富,学习资料多

支持多云部署,架构灵活,适合技术团队深度定制

数据质量和治理功能成熟,适合对数据规范要求高的企业

缺点

企业版价格较贵,对中小企业不友好

中文本地化支持差,国内几乎没有专业服务团队

国内ERP系统(金蝶、用友等)适配需要大量二次开发

(3)DataWorks(阿里云)

阿里云原生大数据开发治理平台,深度绑定阿里云生态

核心功能

数据集成:支持50+异构数据源的离线和实时同步,内置Reader/Writer插件

实时同步:基于阿里云DTS(数据传输服务)实现数据库CDC实时同步

全链路数据开发:从数据采集、开发、调度、到数据服务,全流程覆盖

数据治理:内置数据质量、数据地图、数据血缘、权限管控等治理模块

智能调度:支持复杂任务依赖、自动重试、告警通知

优点

与阿里云MaxCompute、Hologres、OSS等大数据产品无缝打通,生态完整

企业级稳定性强,阿里巴巴自身业务验证,支撑超大规模数据量

数据治理功能全面,适合需要统一数据资产管理的大型企业

按量付费,弹性扩容,无需自建和维护基础设施

缺点

强绑定阿里云,迁移到其他云或私有化部署成本极高

产品体系复杂,模块众多,学习曲线陡峭,上手周期长

非阿里云环境下的数据源接入会有额外的网络和配置成本

对私有化部署需求的企业不友好

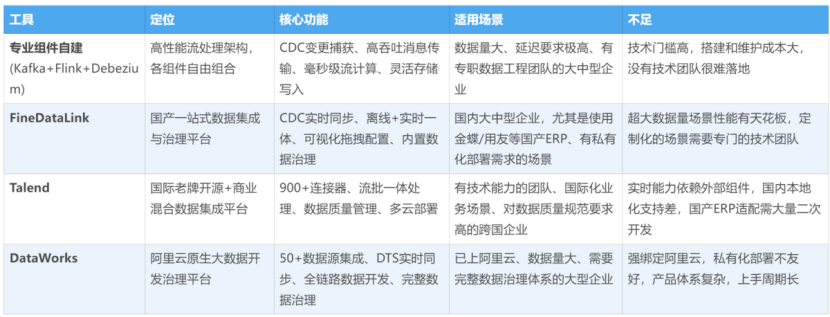

工具总结与对比

Q1、一站式工具和自建架构,到底怎么选?

A:这个问题没有标准答案,核心看团队技术能力和业务复杂度。

如果你的团队没有专职的数据工程师,或者项目周期紧、需要快速落地,选一站式工具FineDataLink、DataWorks更适合。它们把底层的复杂性封装好了,你只需要关注业务逻辑。

如果你的数据量很大、业务逻辑复杂、对延迟要求极高,或者需要高度定制化的处理逻辑,自建组件架构(Kafka + Flink + ClickHouse)的上限更高,长期来看也更灵活。

Q2、这些工具大概要花多少钱?

A:专业组件自建(Kafka + Flink + Debezium):组件本身全部开源免费,但真实成本在人上。另外还有服务器资源成本,视数据量而定,云服务器每月几千到几万不等。

FineDataLink:个人版免费,企业级服务付费,根据数据源数量、并发量和功能模块而定。私有化部署版本通常需要一次性买断或年费,价格会更高。

Talend:开源社区版完全免费,功能基本够用。商业版(Talend Data Fabric)价格较贵,对中小企业不太友好。

DataWorks(阿里云):基础版免费,包含基本的数据集成和调度功能,适合小规模试用。专业版和企业版按量付费,费用取决于使用的计算资源、存储量和功能模块。需要注意的是,DataWorks 本身的费用只是一部分,背后依赖的 MaxCompute、Hologres 等计算存储服务也需要单独付费,综合成本要算清楚。