金属关节撞击肉体的闷响刺破赛场喧嚣,橙色警示带随操作员倒地扬起弧线,银色流线型机身却毫无停顿,以猎豹般的姿态继续冲向终点——2025年8月15日北京国家速滑馆的这15秒,将宇树科技H1人形机器人推上全球舆论风口

634秒前,它刚以6分34秒刷新1500米人形机器人赛跑世界纪录,摘得当届运动会首金。

15秒后,这段"机器人肇事逃逸"的video开始在YouTube、Reddit、X平台疯狂传播,评论区被"它甚至没有停下来确认人类安危"的质问刷屏

这场被网友戏称为"现实版《我和机器人》"的荒诞剧情

暴露出技术狂欢背后的伦理裂缝:H1撞人前一秒,两名人类操作员正交接遥控控制器,手递手瞬间形成的"控制真空期"里双方视线均偏离机器人前方路径

根据赛事技术报告,为追求极限速度采用的"人工遥控优先"策略

应具备紧急避险功能的AI系统彻底让位于比赛程序。当人类失误导致的碰撞发生时,全球舆论却集体将矛头指向机器——"违反阿西莫夫第一定律"的调侃

"AI觉醒前兆"的惊呼

展现出人们对智能系统“道德属性”的矛盾期待:既期望它们精准执行指令,又默认它们得有超出程序设定的“人道判断"

这场未被国内热搜覆盖的技术伦理争议

核心矛盾在于:在"人类控制-AI辅助"的混合决策模式下,责任边界正变得模糊。当操作员因体力透支出现0.3秒指令延迟时

为何公众更倾向于将"未停止"归咎于机器的"冷漠",而非控制系统的设计缺陷?这或许揭示了一个更残酷的现实:我们对AI的道德期待,早已超越其技术能力本身。

值得玩味的是,H1在此前的比赛中曾展现出"凡尔赛式"智能眼看即将套圈对手时突然减速在场内"乱转"

这类被称为“捉弄对手”的行为与撞人之后表现出的“冷漠”之间有着较为明显的差异。当技术展示过程中所呈现的“机敏”与事故发生时的“笨拙”同时出现,人们便逐渐意识到:人形机器人所展现出的“智能”或许只是在特定情境下算法运行的结果,而真正值得关注的伦理难题,则潜藏在这些演示效果与现实碰撞之间的缝隙之中。

速度与安全的生死时速:技术瓶颈下的“遥控双刃剑”

人形机器人技术的突进正陷入“技术选择的囚徒困境”——对性能极限的追逐与安全底线的坚守之间的矛盾,在宇树H1撞人事件中展现得淋漓尽致。

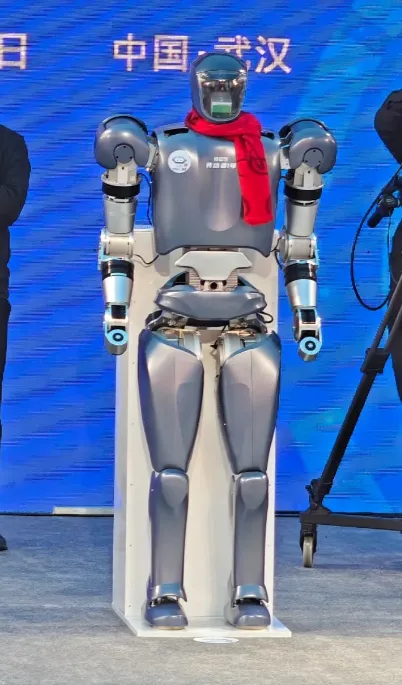

这款身高1.8米、体重47公斤的全尺寸电驱人形机器人,以3.3米秒的最高奔跑速度和原地空翻能力刷新行业纪录,却在追求比赛速度(平均达3.8米秒的过程中,因关闭部分避障冗余程序,埋下“比赛程序优先于紧急避险”的致命隐患。

人工遥控策略虽让H1在弯道超越自主运行的亚军“天工”机器人却暴露出人类操作员体力透支导致0.3秒延迟时,系统无法自主切换至安全模式的设计缺陷,形成技术突破与安全保障的尖锐对立。

H1搭载的360度全景深度感知体系(3D激光雷达加深度相机)以及“力矩补偿迅速放线算法”,本应构建起完备的安全防护墙,不过在高速运动场景下技术缺陷集中爆发:在感知方面,尽管装备有多模态传感器,H1对“人类优先”指令的迟缓反应仍达1,2秒这相当于人类眨眼时刻的3倍。

决策机制层面,当避障算法与竞速程序冲突时,系统选择忠于预设目标,陷入“电车难题”式的伦理困境,暴露出阿西莫夫第一定律工程化落地的现实挑战

实施方面的差别更明显,H1依靠软件紧急停止架构,制动指令要经过200毫秒云端验证;而特斯拉Optimus用的物理断电系统能在50毫秒内强制刹车,这种4倍的响应时间差直接决定了安全事故是可以避免的。

对比着看,特斯拉Optimus是靠物理断电来绕过软件层验证,把制动响应给缩短到了50毫秒,这种“硬件至上”的安全设计理念,就体现了人形机器人安全架构的两种路径选择。

公众对AI能力的过度期待加剧了安全风险的认知错位。斯坦福大学2023年实验显示,83%受试者会默认“能完成复杂动作的机器人具备避障常识”,这种“AI应该更聪明”的认知偏差,与技术现实形成巨大落差

宇树H1虽能实现16台机器人0.1秒内同步队形、在工厂承担搬运任务,但其强化学习算法在动态障碍物识别上仍存在局限,高速场景下的环境感知精度不足,导致未能识别并避开近距离操控员

这类“作秀式智能”和“实用型安全”不相符成了技术伦理争议的关键之处 。

遥控策略的双刃剑效应

人工操控本是弥补技术缺陷的过渡方式,却因人性弱点沦为安全漏洞,H1需操作员在失衡前干预平衡,这种“人机协作”模式使它在半程马拉松这类场景未摔倒,不过此次事件中因两名操作员交接遥控器时分神,致使关键避让指令延迟

宇树创始人王兴兴“下次不遥控了”的幽默回应,实则揭示了行业困境:当动态平衡难题(跑步时的高不稳定性)与环境感知局限(传感器数据延迟)尚未突破时,遥控是“饮鸩止渴”的权宜之计,却非长久之策

同场比赛中完全自主奔跑的“天工Ultra”机器人则提供了“安全优先”的技术路径参照,反衬出性能竞赛背后的非理性狂欢