Token经济的爆发速度超出了绝大多数人的预期。

大模型应用遍地开花,日均调用量突破140万亿——2026年被业界视为转折之年。与此同时,国产芯片的本地化率也随之攀升,2025年已达到41%,英伟达在中国市场的份额从曾经宣称的95%骤降至55%左右。一个清晰的信号正在释放:国产AI算力,正在从“可用”走向“主流”,并悄然登上主桌。

但算力只是入场券。真正让行业绷紧神经的,是另一件事:AI能提效,也意味着AI能“惹祸”。

今年3·15晚会曝光的GEO技术大模型“投毒”黑幕,揭示了一种全新攻击路径——攻击者往训练数据里掺恶意样本,让模型“吃坏料”,输出结果被暗中扭曲。这种“数据投毒”已被视为2026年安全领域的头号威胁。

此外,算力劫持、运行时数据泄露等新型风险也在真实环境中频频出现。传统的外挂式安全——在网络层、主机层、应用层堆防火墙——在AI算力集群面前显得后知后觉。这套源于“边界防御”思维的体系,正在被大模型复杂的训练和推理流程所瓦解。

一个越来越强的共识在行业里蔓延:安全,是AI的入场券。金融、政务这些关键行业,未来不会允许任何未经硬件级安全验证的AI系统上线。这意味着,算力竞争的下半场,拼的不只是每秒浮点运算次数,而是从第一条指令开始就值得信赖的“底座能力”。

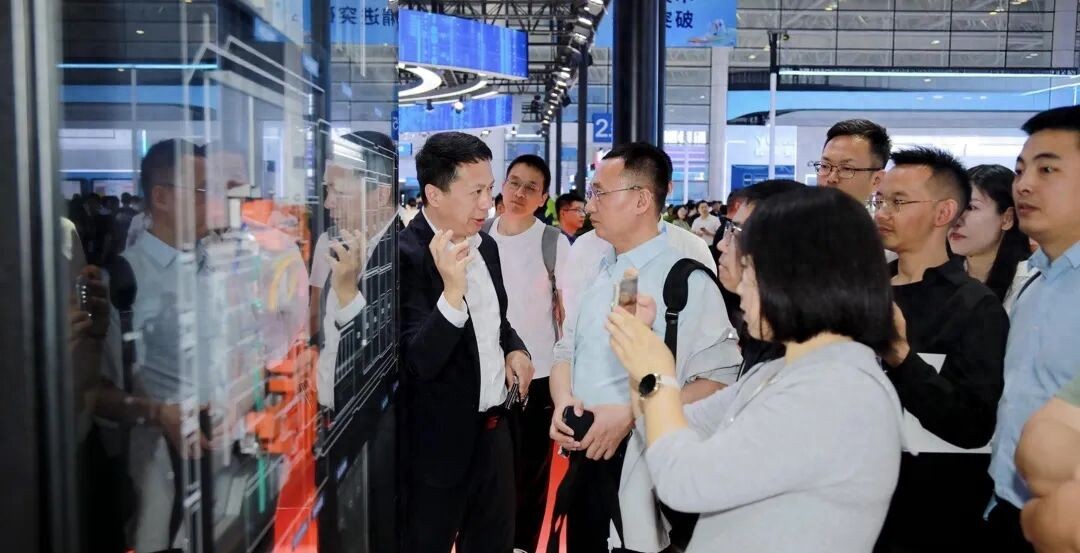

这一判断,在第九届数字中国建设峰会上,得到了一次集中而具体的回应。峰会上,海光集中展示了从CPU、DCU到全栈解决方案的自主创新成果。

在此基础上,海光同步推出两款联合方案:一是与上海CA联合推出的芯密全栈密码服务平台,二是与亚信科技联合推出的智能可信数据空间。

芯密全栈密码服务平台依托CPU内置的国密二级密码模块,实现了从传统“外挂密码”到“内生密码”的架构升级。平台面向云、边、端提供一体化的密码能力,对外公布的数据是:改造时间降低一半,建设成本降低70%。对银行、政务、通信等正在推进国产化改造的行业来说,这意味着合规级密码保障不再是一个高门槛、高成本的难题。

智能可信数据空间则以隐私计算和区块链为底层技术,配合芯片级的TEE(可信执行环境),实现数据跨主体“可用不可见”——从数据传输到计算的全过程保持加密隔离。对于数据合规要求极高的金融、政务、医疗等行业而言,这套方案意味着AI应用从“试点”走向“规模化上线”时,安全将不再是那道绕不过去的瓶颈。

支撑这两个联合方案的,是一套被称为“内生安全”的技术体系。该体系在峰会前一个月刚刚正式发布,其核心逻辑是把安全能力从软件层下沉到芯片层,从CPU启动第一条指令开始就建立不可篡改的信任链。技术架构分为三个互相咬合的层级:

第一层是可信计算,CPU内置硬件可信根,逐级度量BIOS、操作系统等任何环节是否被篡改,一旦发现异常即停止运行;

第二层是机密计算,即便在云环境的内存中,数据也保持加密状态,云厂商、管理员、恶意租户都无法读取明文;

第三层是密码加速,CPU内置高性能国密协处理器,原生支持SM2/SM3/SM4,密钥全程在硬件中管理、永不离开CPU内部。

当AI算力从“能用”迈向“好用”,安全就不再是一个可选项,而是决定产业走多远的基础命题。可以预见,2026年之后,谁能在芯片级安全上构建起不可绕过的护城河,谁才能真正站上AI算力的主桌,这正是算力竞争下半场的真正赛点。