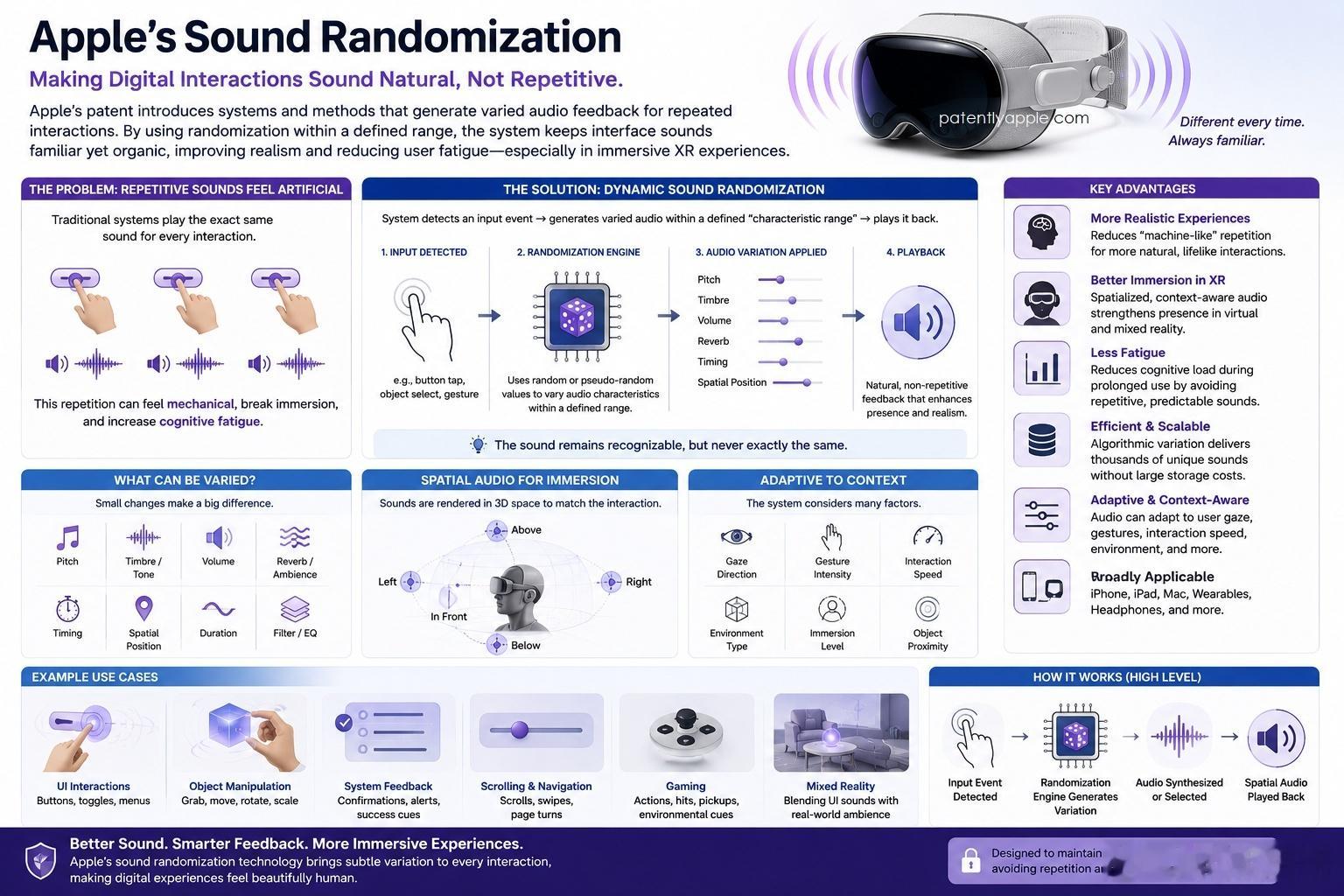

Apple近日获批一项新一代自适应音频反馈系统专利,旨在优化未来空间计算场景下的交互体验,让虚拟环境中的操作更自然、沉浸感更强,摆脱刻板机械的重复感。

这项专利的核心设计,是通过随机、伪随机算法动态调节界面音效,避免相同操作每次都播放完全一致的音频反馈。

看似只是细微调整,却直击沉浸式设备的关键痛点:长时间佩戴Vision Pro这类扩展现实设备时,循环不变的界面音效会显得刻意生硬,极易造成听觉疲惫,还会干扰专注力。Apple的解决方案,在保留界面提示辨识度的前提下,为音效加入可控的细微变化,让数字交互的听觉感受更贴近现实世界的自然质感。

这项专利也体现出,Apple高度重视未来空间计算交互的心理感知与感官真实度打磨。

专利核心逻辑在于:点击、选中、手势确认、页面滑动、虚拟物件操控等重复交互行为,不必每次都输出一模一样的音效。

Apple提出,在保持各类交互专属音效风格辨识度不变的前提下,利用随机数值微调声音参数,让音效始终处在固定听觉特征区间内,同时产生细微差异。

例如连续选中同一虚拟按钮时,音效可以实现:音色质感轻微差异、音调小幅偏移、混响特质微调、触发时序微妙变动、三维空间声场位置动态变化。

用户仍能识别,这是同一种交互行为,但整体听觉氛围不再生硬刻板,大幅降低长时间使用带来的感官疲劳。

这项技术虽可适配Mac、iPad、智能眼镜等多款Apple硬件,但专利重心明显偏向虚拟现实、混合现实、增强现实这类扩展现实设备。

文件多次提及头戴设备、视线追踪、手部追踪、手势操控、空间界面、虚拟控件与沉浸式场景。系统可通过眼部动作、手部手势、触控平面、外设手柄及空间输入识别用户操作,再匹配生成对应的自适应音频反馈。

在传统手机端,音效仅作简单提示;但在空间计算环境中,声音对交互感知的影响被大幅放大。用户高度依赖方位音效、操作确认提示、空间化界面反馈、环境氛围声与声场定位,来理解虚拟场景逻辑与交互结果,而细腻的音频真实感,也将成为未来沉浸式设备拉开体验差距的关键。

这项专利一大亮点:在不大幅增加存储占用的前提下,实现海量音效变化。

Apple并未采用预先存储大量独立音效素材的方式,而是通过算法实时调校基础音频参数,依托随机化规则、伪随机数值、音频特征区间与自适应播放逻辑,用少量基础音源,生成成千上万种听觉有差异的界面音效。

这一思路契合Apple计算媒体生成的产品理念:依靠软件算法实时优化体验,而非单纯依赖静态预录素材堆砌。

专利还透露,该系统后续将具备场景感知能力,可根据不同条件自动生成差异化音效变体,参考维度包括用户注意力、视线方向、手势力度、操作快慢、场景类型、沉浸程度、虚拟物件距离以及用户移动状态等。

系统会监控用户视线、手部动作、环境状态与扩展现实交互状态,让界面音效随空间交互方式动态变化。比如轻手势对应更轻柔的反馈音、快速操作匹配更利落的音效、沉浸场景自动调整混响效果,音效也可在三维空间中动态偏移声场位置,远不止简单的随机播放。

这项专利是Apple布局Vision系列生态的又一环。近年相关专利持续聚焦视线真实还原、视觉画面校准、空间录制、触觉反馈、环境沉浸、自适应光学、动态界面逻辑以及空间音频写实化等方向。

Apple并未将扩展现实设备单纯视作显示硬件,而是致力于打造多感官同步自然的完整体验生态。看似细微的界面音效优化,实则体现出Apple对XR底层感官细节的深度打磨。长时间佩戴头显若反复听到完全相同的机械提示音,会严重削弱沉浸真实感;而这套可控的随机变化设计,复刻了现实世界声音的自然随机性,有效化解这一问题。

尽管专利以XR设备为核心,但明确说明该技术可覆盖Apple全品类硬件:穿戴设备、iPhone、iPad、MacBook、AirPods、台式设备、触控外设及游戏设备均在适配范围内。

未来iOS、macOS、watchOS、visionOS都有望搭载这套自适应音效算法,让全系设备的系统交互都更自然、减少重复机械感。

同时该技术也延续了Apple长期在空间音频领域的积累,目前已落地于AirPods、Vision Pro、Apple TV、HomePod等产品线。随着计算界面愈发偏向沉浸式、场景化,这类细节音效技术,将成为决定未来数字环境人机交互自然感的重要一环。