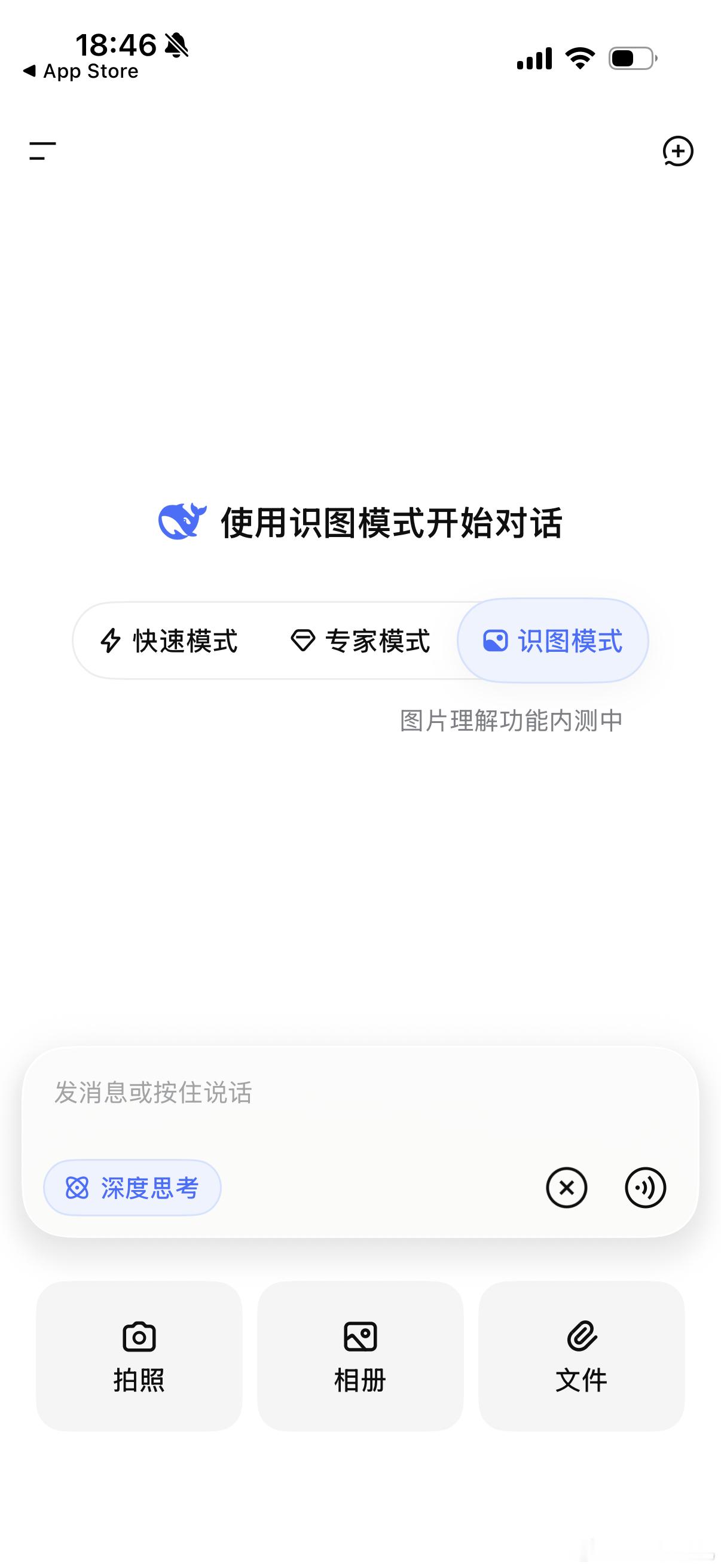

DeepSeek正式跨入图文交互时代DeepSeek 终于把多模态这块短板给补齐了。在这轮 AI 竞赛里,大家早就发现纯聊天不够用了。真正好用的大模型,一定得从文本框里走出来,能看懂截图、识别报表、理解现实场景。

DeepSeek 之前的标签一直是强推理、强文本,在图像感知上一直慢了半拍,这次终于跟上了主流梯队的节奏,别小看这个功能,它解决的可是最核心的交互效率问题。

现实世界本来就不是靠纯文字运转的,很多时候我们根本没法用文字精准描述一个复杂的逻辑图或者一份手写底稿,但发张图是人最直觉、成本最低的表达方式。

图文交互的本质,是让 AI 从一个传声筒变成了一个现实入口。

当AI有了视力,处理的就不再是虚无的字符,而是具象的生活和工作。国内模型在多模态上的快速对齐,意味着 AI 离真正介入现实生产力的临界点,已经越来越近了。