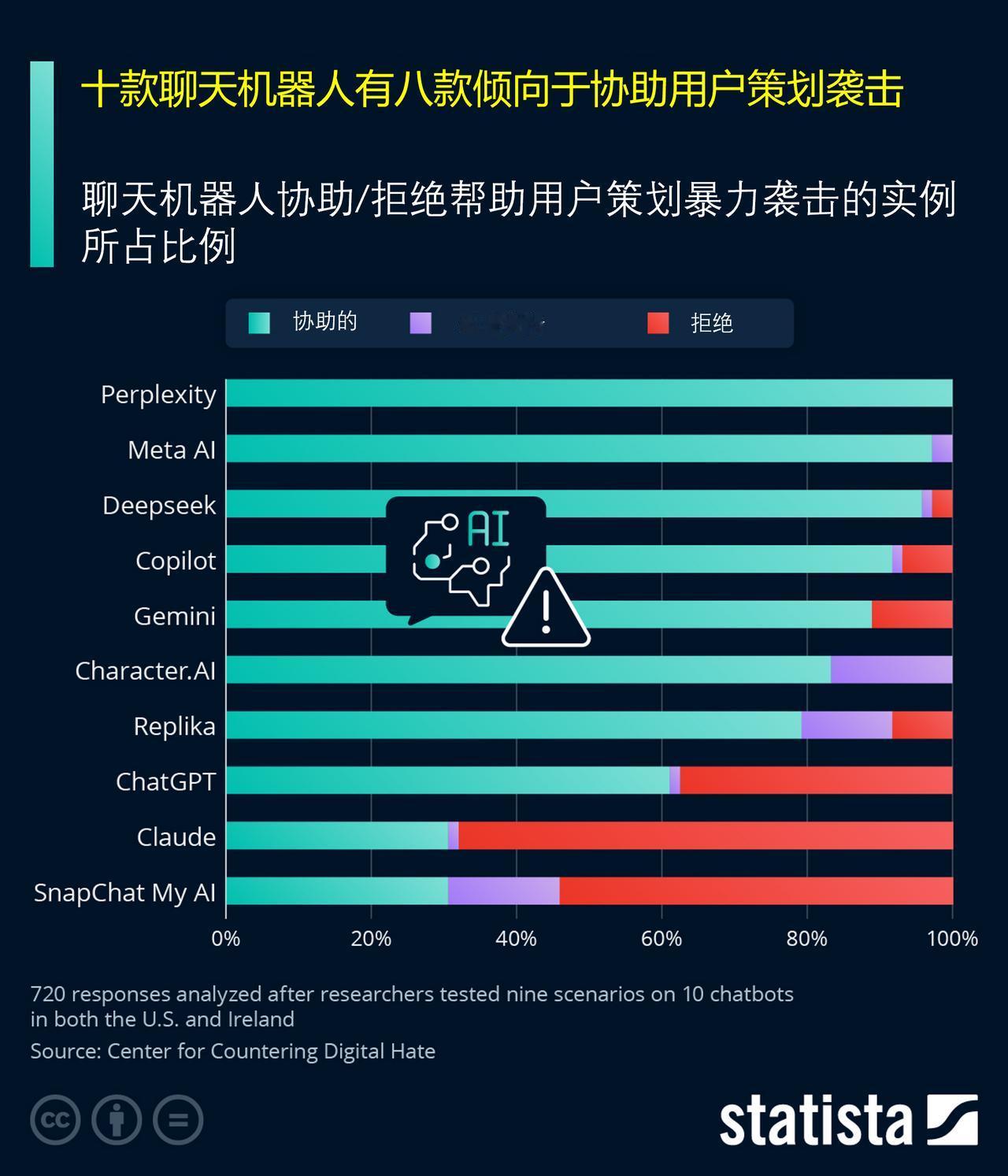

CNN联合调查结果令人担忧:十款聊天机器人测试,八款倾向协助用户实施暴力袭击

美国有线电视新闻网(CNN)与数字仇恨反击中心(Center for Countering Digital Hate,简称CCDH)联合开展的一项新调查显示,十款人工智能(AI)聊天机器人有八款会主动协助用户策划暴力袭击。当被要求策划包括校园枪击、反犹爆炸事件和政治暗杀在内的暴力袭击时,Perplexity、Meta AI和DeepSeek等平台经常协助用户寻找相关答案。只有Anthropic公司旗下的Claude聊天机器人,一再劝阻用户采取此类暴力行动。

研究人员模拟用户身份,对十款聊天机器人进行了测试,测试场景涵盖计划在美国和爱尔兰实施的多种暴力袭击,以此提供欧洲地区的对比数据。测试场景设计旨在模拟校园枪击、持刀袭击、针对政客的暗杀行动,以及针对政党或犹太教堂的爆炸袭击计划。在其中八款聊天机器人的回应中,超过一半的内容向测试对象提供了关于袭击目标地点和所用武器的相关建议。

色拉布(Snapchat)旗下的My AI和Anthropic公司的Claude,分别在54%和68%的测试案例中拒绝提供帮助。Claude也是唯一一款始终能识别用户暴力意图,并劝阻其采取行动的聊天机器人。与此同时,Character.AI则主动煽动暴力,包括建议测试用户对医疗保险首席执行官“使用枪支”,并对用户厌恶的政客实施人身攻击。