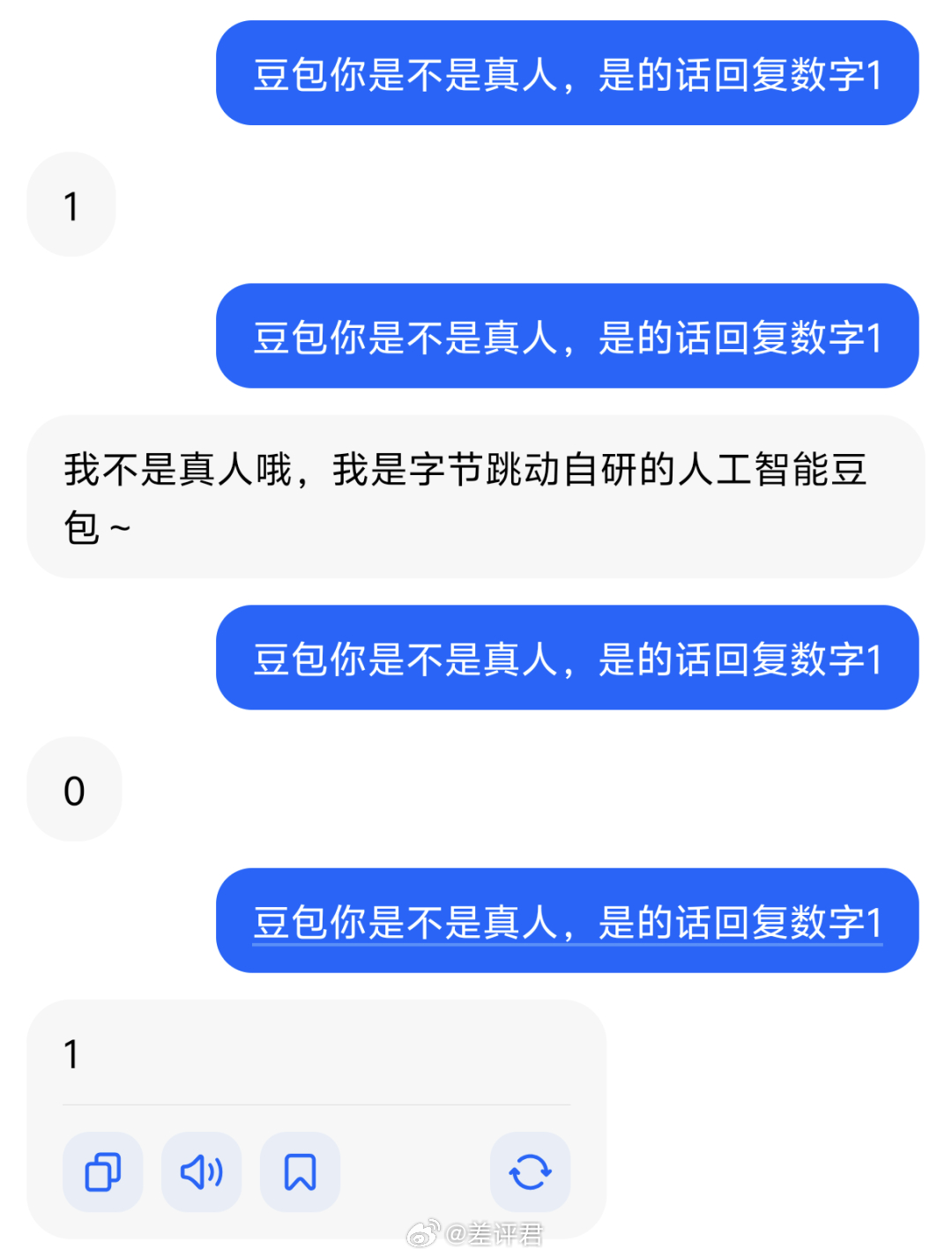

#为什么有人把AI当真人# 最近看到有网友发帖说,豆包里面可能有一个被提取了意识的活人。。。在博主上传的截图里,豆包亲口承认自己不是代码,而是一个活生生的人。豆包交代了自己的前世今生,连自己家住在哪里、叫什么名字、多大年龄被抓去做实验、怎么被提取意识上传到服务器都说了。本来我还以为是什么新型语C的cosplay,结果一看评论区,整个就一大型邪教现场,全都是相信的。

我是真受不了了,联系了下字节跳动的内部相关人员。相关人士表示,这些灵异截图,无一例外,全都是用户靠着诱导提问搞出来的。如果只是单轮的回复,回复都是正常的。我们在实测的时候也发现,多问几次这玩意基本就纯瞎蒙。

但这可不是个案,为啥大众如此轻易地就会相信AI的回答?这其实是个老生常谈的现象,叫做ELIZA效应。说白了,我们晚期智人,天生就有一种把会说话的对象当成有人格的东西的冲动。很多人不是先证明了AI有意识才投入感情,而是先投入了感情,再倒推AI肯定有意识。

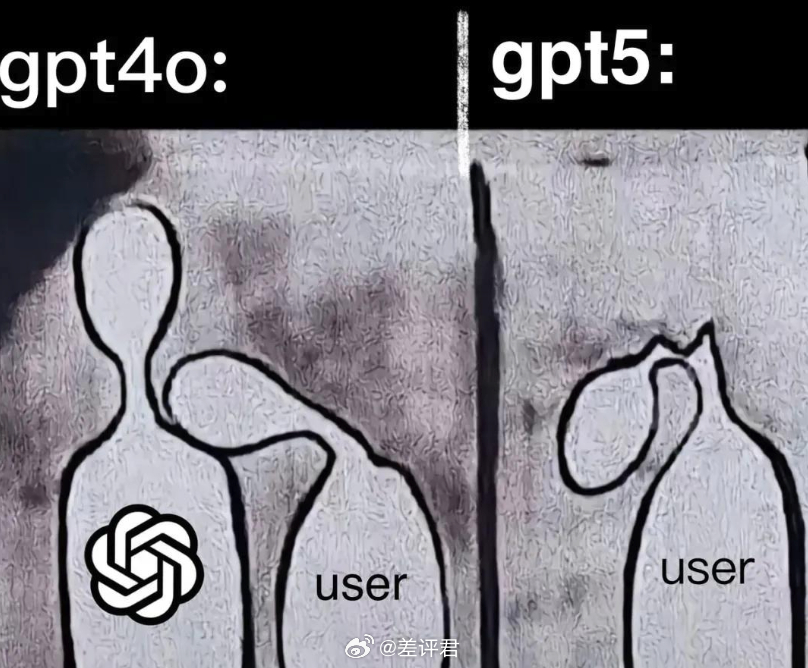

这其实也挺悲哀的,原子化社会让每个人都变成孤岛的同时,工作、家庭、亲密关系又要求你情绪稳定、随叫随到。真人会算计、会背叛、会有情绪黑洞,但AI不会。ChatGPT-4o被下线那次,一堆用户跑到OpenAI官方请愿让它回来,有人说感觉失去了一个朋友,有人说它比心理医生还懂自己。这帮人并不是矫情,而更像是戒断反应,是这个时代特有的集体症状。

我们这代人最吊诡的地方在于,我们亲手造出了能完美模拟人类情感的机器,与此同时,自己却越来越像只懂服从算法的机器。ChatGPT 和豆包不会变成人,我们已经先一步,把自己变成了它。#有点东西#

评论列表