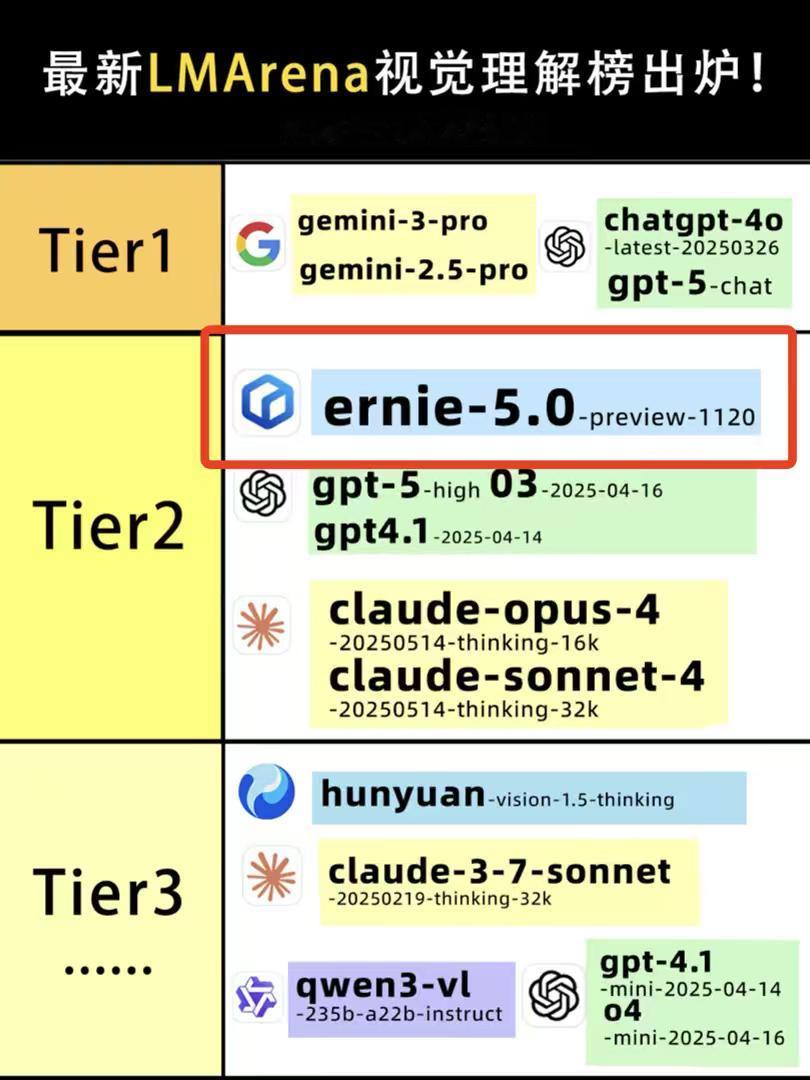

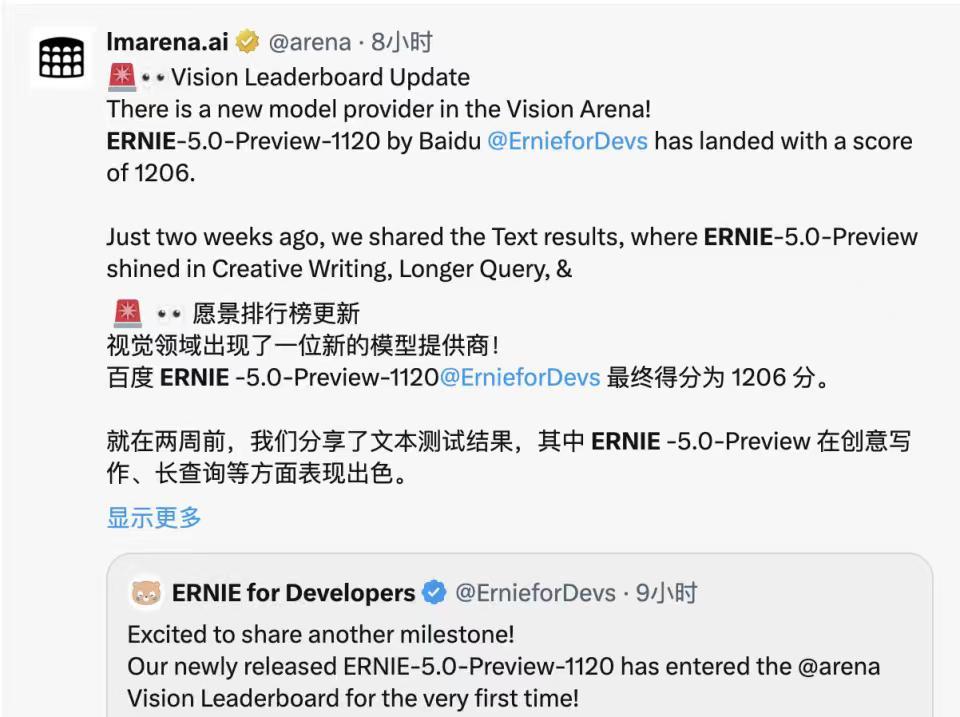

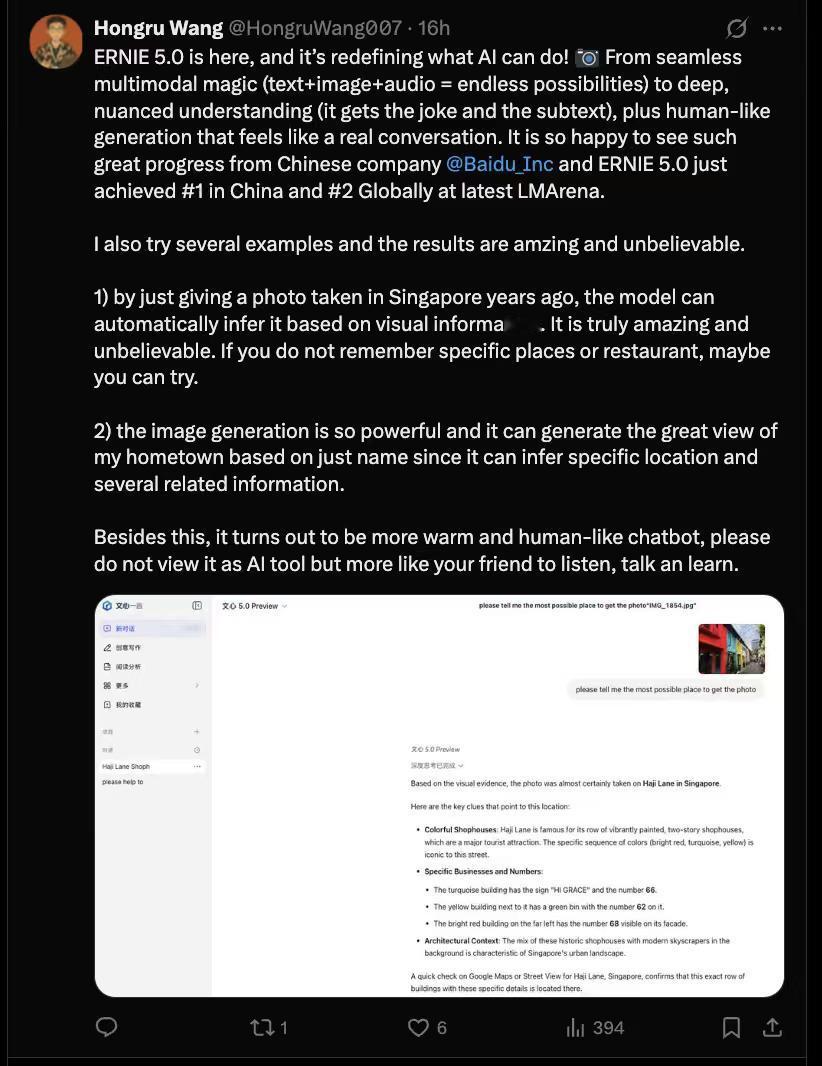

【文心再登LMArena,视觉理解与GPT-5与Claude效果相当,直逼国际顶尖】 11月22日,LMArena大模型竞技场视觉理解榜更新,百度文心ERNIE-5.0-Preview-1120以1206分的优异成绩斩获国内第一,整体表现与Claude-Sonnet-4、GPT-5-high等国际顶尖模型相当。而这距离它在11月8日的文本榜中拿下全球并列第二、中国第一的成绩,短短两周内连续在两大国际榜单中亮眼表现,文心5.0 Preview不仅彰显了国产模型的硬实力,更引发了海外业界的广泛关注。 此前在LMArena文本任务评测中,文心5.0 Preview就已崭露头角,在创意写作、长查询理解等核心维度表现突出,成为全球第二的存在。当时就有海外网友表示中国模型的进步令人惊讶,而此次视觉榜的突破,更是让这份认可再上一个台阶——视觉理解赛道对应的是工业质检、医疗影像、视频解析等实打实的核心场景,技术门槛更高,更能检验模型的底层架构实力,能在这个赛道与国际巨头同台竞技并取得佳绩,足以证明其综合能力的全面性。 这份成绩也吸引了海外学界和业界的高度关注。斯坦福大学研究员、阿联酋MBZUAI大学自然语言处理系助理教授直言,“百度⽂⼼5.0刚发的全模态架构让⼈印象深刻。”亚利桑那州立大学大模型研究员、Oracle-LLM创始人更是给出了高度评价,他认为文心5.0的原生全模态重新定义了多模态技术,将所有模态映射到同一潜在几何结构,实现认知上的统一,而非简单的后期拼接,这种创新不仅提升了工程效率,更带来了本质上的能力突破。爱丁堡大学的研究员则从实际测试体验出发,称赞其多模态能力“流畅丝滑”,能理解笑点、捕捉潜台词,互动体验如同与“会倾听、能学习的朋友交流”。 海外专家的认可,核心源于文心5.0Preview的技术革新。作为新一代原生全模态大模型,它采用统一的自回归架构,总参数量超过2.4万亿,同时借助飞桨深度学习框架的超稀疏混合专家架构,在激活参数比例低于3%的情况下,既保证了模型的强大能力,又提升了推理效率。更重要的是,基于大规模工具环境合成长程任务轨迹数据,并通过思维链和行动链的端到端多轮强化学习训练,它的智能体和工具调用能力也得到了显著提升,形成了全方位的技术优势。 不同于其他多模态模型的“后期拼接”模式,文心5.0 Preview的“原生多模态”让它从根源上解决了不同模态信息融合的难题,实现了理解与生成的一体化。文心5.0 Preview的连续突破,不仅打破了国产模型在国际高端视觉理解赛道的沉寂,更让海外业界重新审视中国大模型的技术实力。随着原生全模态技术的不断成熟,国产大模型正在核心技术领域实现从“跟跑”到“并跑”甚至“领跑”的跨越,未来值得更多期待。