DeepSeek团队都来自国内顶尖高校

最近有些人觉得恐怖,deepseek的思维链很像人了。我解释一下是怎么出来的,还是算法,不要怕

在deepseek app里,点击深度思考(R1),机器就不仅输出最后答案,还把中间的思维过程展示出来。

一些人就觉得很恐怖,很像人了。这个不要怕,是模拟出来的思维链(COT, Chain of Thought)。

以前的大模型直接输出结果,没有这个COT中间输出。直接输出的,其实是文字序列,一个个词吐出来。

从OpenAI的o1开始,思维链流行起来。其实没什么,思维链也是文字序列。只不过大模型开发者先给它不少时间,几十秒上百秒,去输出思维链序列。然后再根据思维链,来给出最终结果,如数学题。

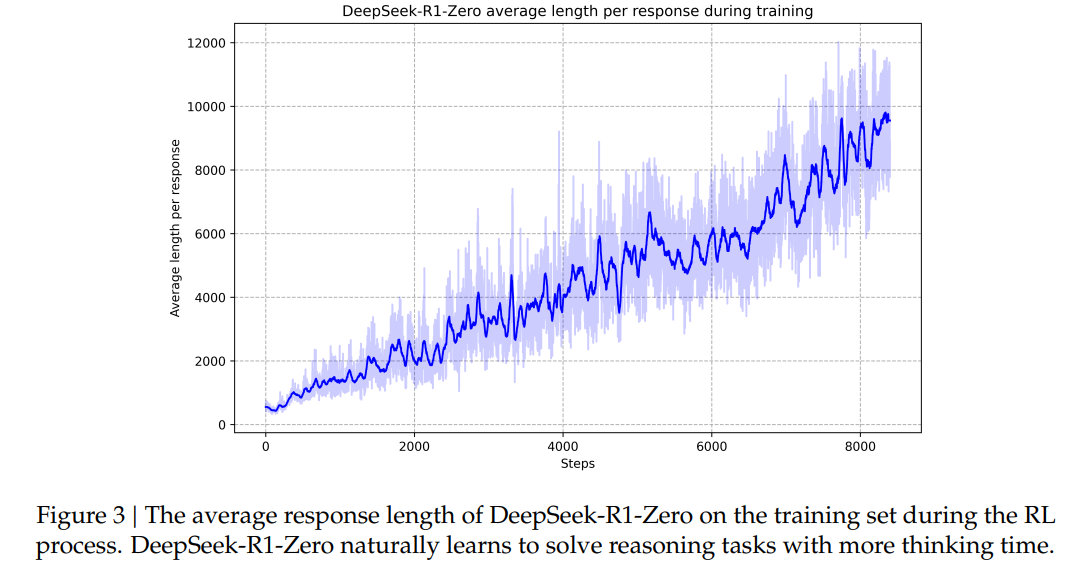

那么思维链是怎么弄出来的?图二,就是deepseek r1-zero的训练,是被开发者强迫训练的。让它必须输出《think》和《/think》包住的COT文字序列。

一开始,大模型输出的COT序列短,也没逻辑。那训练者就搞“强化学习”,改它的系数,让它输出COT能好些,有聪明的训练策略。时间一长,不断改进,这COT输出就越来越好了。

而且大模型自己也发现了,COT挺好玩,似乎思维有本质变化。出现了像是“自我检查”、“反思”的文字序列。其实都是人类强迫它训练的结果,输出的序列像是在反思。因为人类就是这么思维的,机器用文字序列的办法模拟了,不知道自己在干什么。就像AlphaZero,自己从零学习围棋,发现了吃子技术,到一定阶段,还发现了最复杂的“征子”技术。

所以,都是人类设计的输出序列。不像就训练,越来越像,就模拟了人类思维。其实就是把人类思维以文字序列的形式,生成展示出来。大模型只知道文字token,没有感觉,所以不知道自己在干什么。