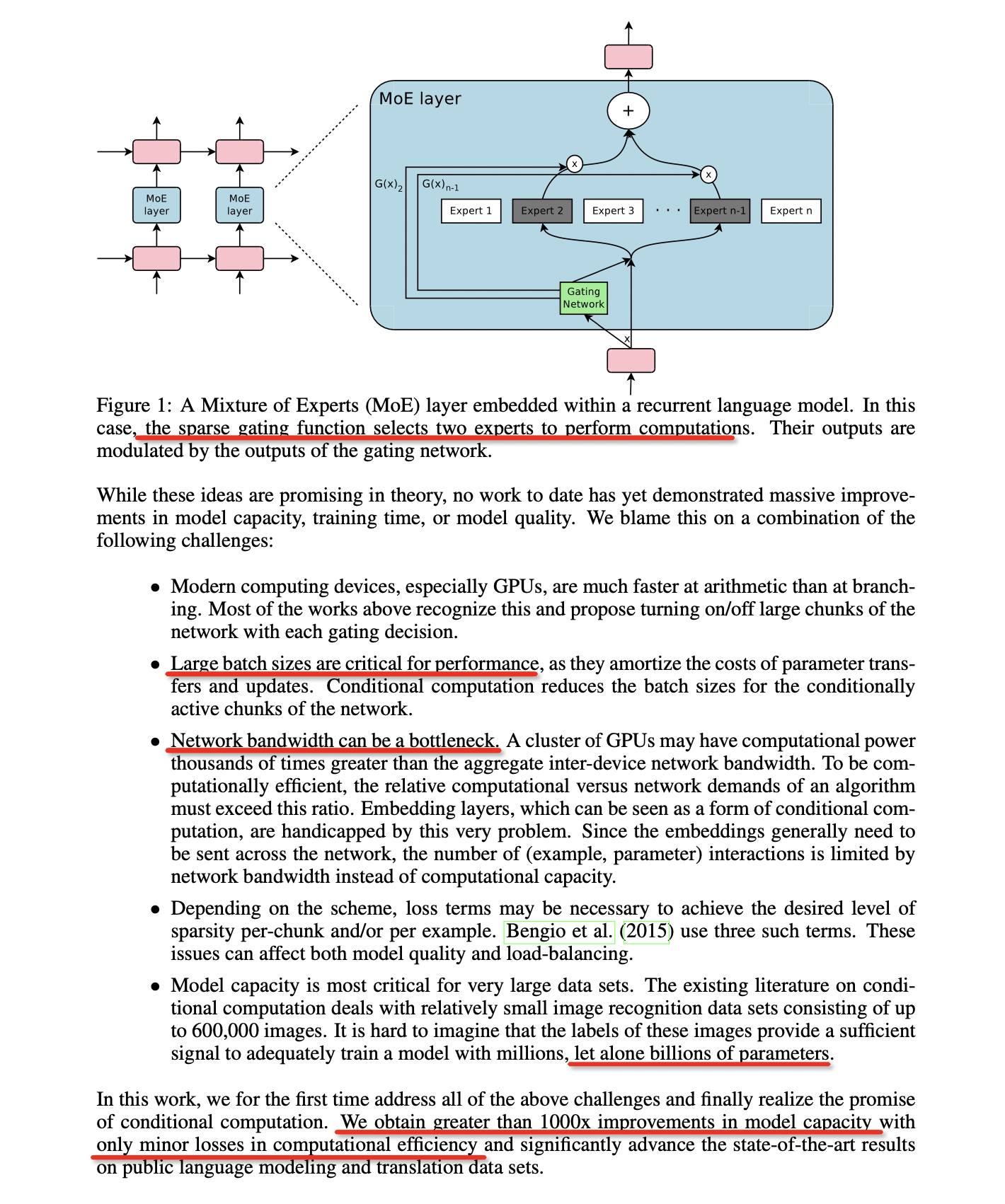

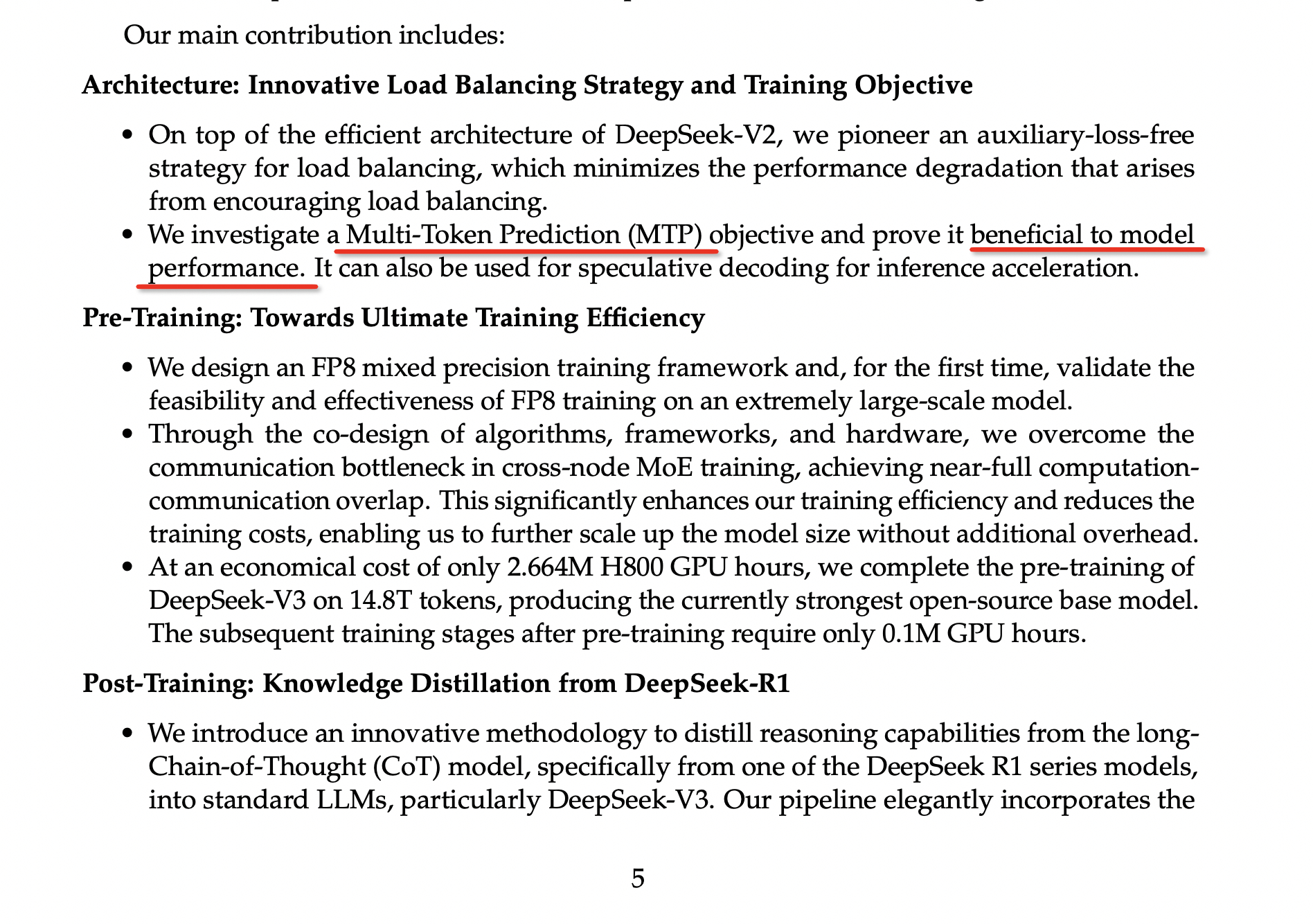

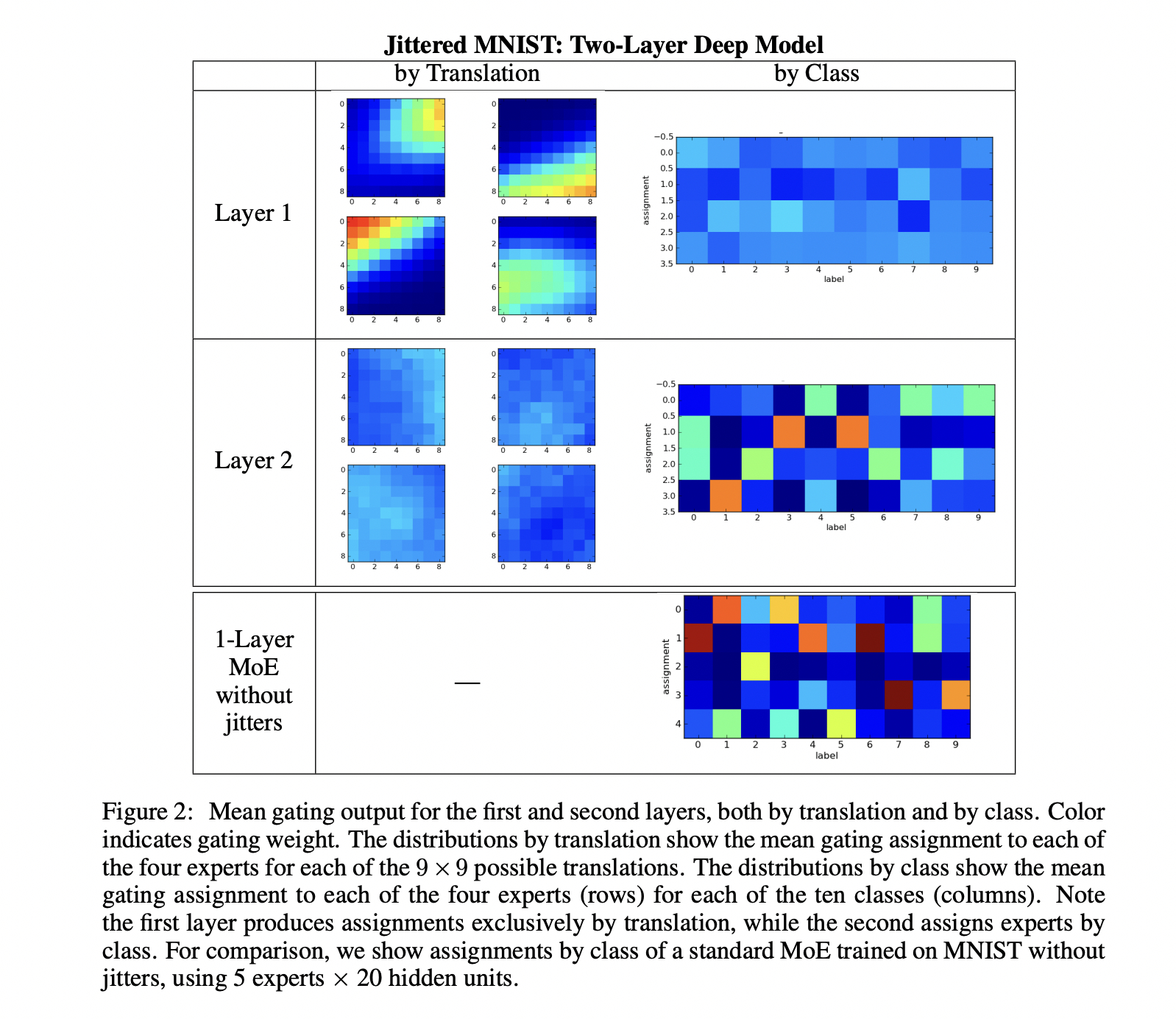

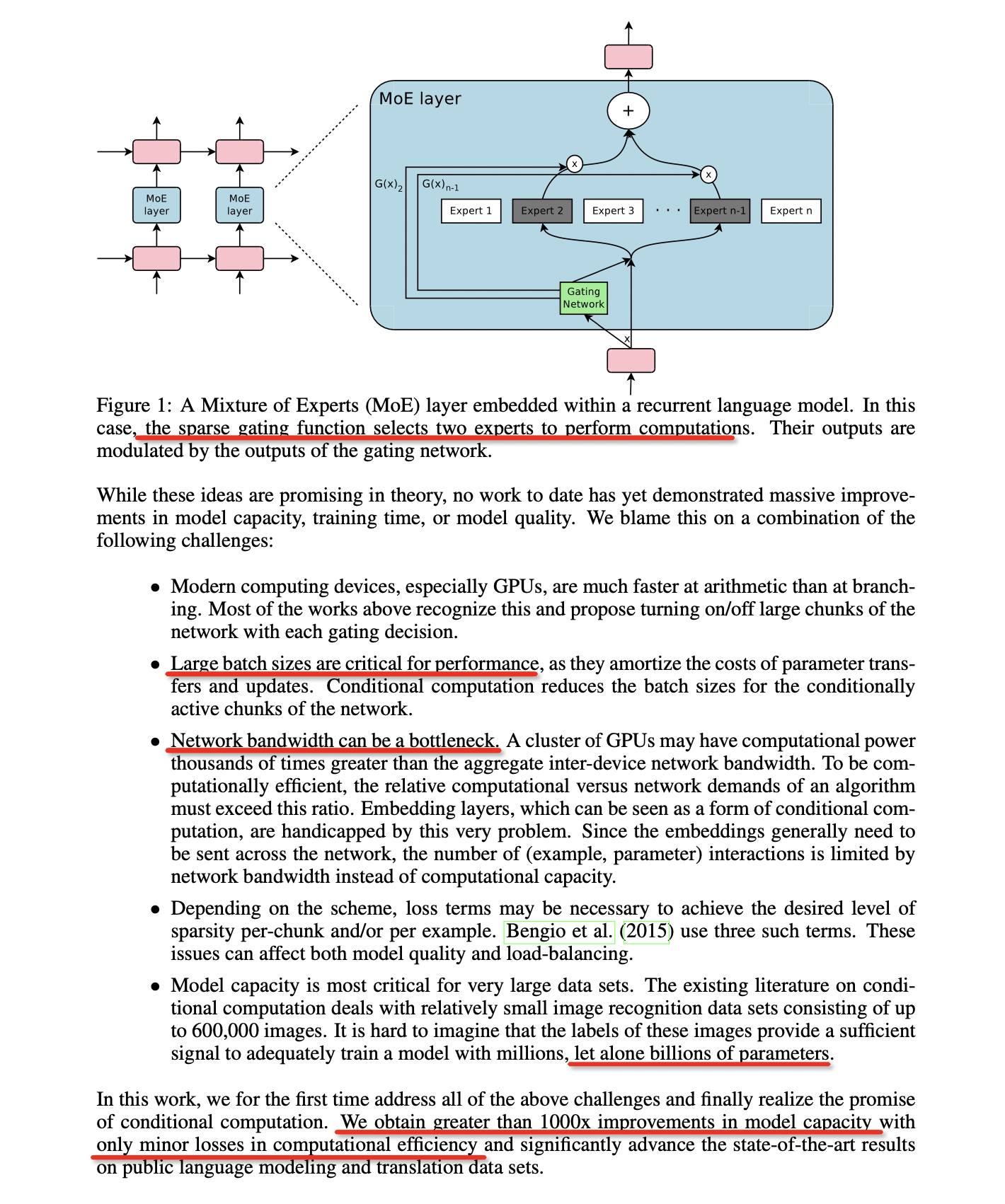

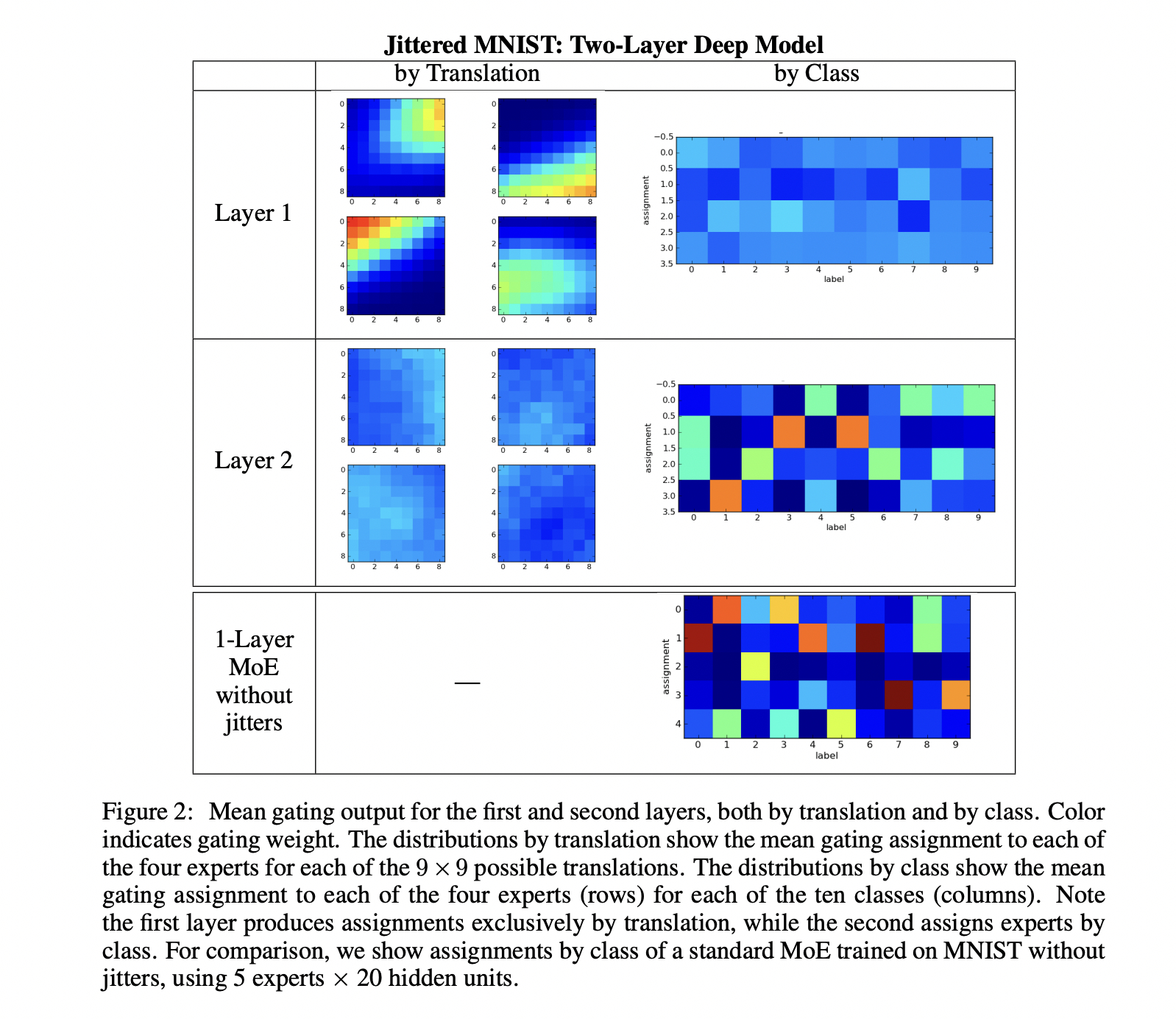

2024年的 DeepSeek 使用的 MoE 灵感来自于 7 年前(2017)的一篇论文,而这篇论文的灵感又来自于 11 年前(2013)的一篇,最后这篇本身是要解决图像识别的

Mixture of Experts 架构本质应该是一种稀疏矩阵编码技术,构建了两层矩阵,一层是寻址矩阵,对一个超大矩阵切分为许多小矩阵进行寻址,以进行交织编码

有意思吧?但是好像 AI 理论专家们没有意识到这个

.

2024年的 DeepSeek 使用的 MoE 灵感来自于 7 年前(2017)的一篇论文,而这篇论文的灵感又来自于 11 年前(2013)的一篇,最后这篇本身是要解决图像识别的

Mixture of Experts 架构本质应该是一种稀疏矩阵编码技术,构建了两层矩阵,一层是寻址矩阵,对一个超大矩阵切分为许多小矩阵进行寻址,以进行交织编码

有意思吧?但是好像 AI 理论专家们没有意识到这个

.