2022年11月30日,ChatGPT正式发布,至今已经三周年。它创造了前所未有的辉煌,成为历史上增长最快的消费级产品之一,但客观来说,ChatGPT并未达到人们期望的高度。

期望与现实:被打破的乐观预言

中立者认为,AGI是可以实现的,AI将为人类带来巨大收益,但类似ChatGPT的大语言模型可能无法孕育AGI;从技术角度看,LLM存在天生顽疾,这是当前人类很难克服的。之前许多大佬曾鼓吹,只要提供更多数据、添加更多GPU,就能催生出通用人工智能。现在,人们对这种论调不再迷信,开始回归冷静。

OpenAI CEO奥特曼还曾宣称,LLM将让生产力提升10倍,很快我们就会看到,一家估值10亿美元的企业,可能只有一名员工。这些假设无一成真。在生产力方面,LLM的确在某些领域可以提升30%,但离宣扬的10倍相去甚远。甚至有研究证明,LLM对程序员产生了负面影响。

《经济学人》更是失望地表示:“生成式AI浪潮已持续三年,但其市场需求却出人意料地疲软。”白宫一位高级官员最近警告称,如果生成式AI出现问题,可能引发经济衰退。投资者猜测,美国可能是想用政府资金补助AI。如果美国经济真的出现衰退,ChatGPT可能会成为风暴中心。

核心困境:始终未解的技术顽疾

当我们将时光拉回到2022年12月,那时的ChatGPT每周都会带来新消息,虽然效果让人惊叹,但问题已经出现,例如,它被幻觉困扰,无法理解物理世界和心理世界,这些问题今天仍然没有解决。一度被业界推崇的“缩放定律”被推翻,哪怕是扩大模型规模,也会犯一些低级错误。虽然AI吞噬了大量的互联网信息,仍然无法提供可靠、全面的医疗建议。

AI无法可靠驾驶汽车,无法操控人形机器人,无法成为可靠的通用工具,无法输出符合人类价值观的信息。从2022年到2025年,美国在AI领域投资数万亿美元,我们不禁要问:“AI到底留下了什么?”从GPT-4.0、GPT-4.1、GPT-4.5到GPT-5,从Claude、Gemini、Grok、Llama、DeepSeek到所有变体模型,都未能解决最根本的问题,而且似乎看不到解决的希望。

对于任何秉持理智诚实的人来说,我们无法不承认:数百个主流模型始终存在相似的失效模式。如果模型真能解决真正的痛点,无疑将具有巨大价值,但它们没有解决。当前的AI模型强大吗?当然强大,但这种强大缺乏有效可控性。AI无法可靠推理,无法与工具协作,存在幻觉,无法解决“对齐”问题。一切都在证明,当前的AI并非完美解决方案。

人工智能批评家休伯特·德雷福斯(Hubert Dreyfus)曾说:“深度学习(LLM 的底层技术)是一架更好的梯子,但更好的梯子未必能带你登上月球。”越来越多的人开始认清真相,开始回归理性,这是好事。事实上ChatGPT 并未真正成熟,它始终未能解决核心挑战。在不借助神经符号系统和世界模型的前提下,它可能永远无法解决这些问题。

泡沫退潮:从狂欢到理性的回归

曾经,媒体跟着CEO们狂欢、摇摆,将ChatGPT吹捧为历史上最伟大的互联网产品,却忽视了搜索引擎的巨大盈利能力以及更高的普及率。几年前,那些宣称AGI将在2-3年内实现的预言家们,今天是否尴尬?

英伟达无疑是这场狂欢的最大明星,过去几年,它的股价疯涨,现在开始回调。11月,英伟达股价下跌16%。许多人都在说,AI泡沫已经触及顶峰。OpenAI没有上市,如果它是上市公司,11月份也会大跌。除了受到大浪潮的影响,还有一个原因是OpenAI 缺乏护城河。

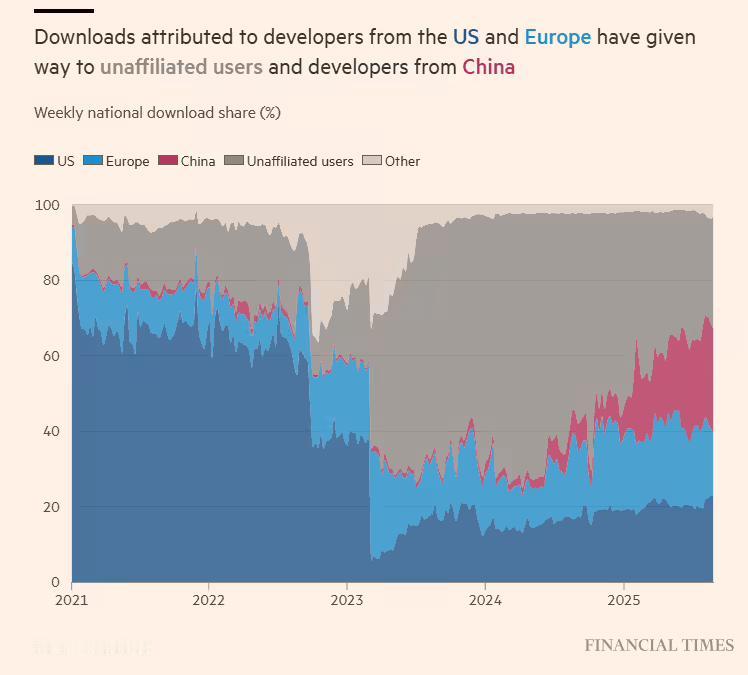

ChatGPT 技术很容易复制,没有多少核心机密。因为复制者太多,ChatGPT 必然面临价格战。到今天,除了英伟达从LLM生态中赚到钱,其他企业几乎都陷入亏损,无法自拔。现在连OpenAI CEO奥特曼也承认,公司面临阶段性经济风险。为什么OpenAI估值能飙升到5000亿美元?不是因为它多能赚钱,而是因为预期。现在这种预期正面临挑战,可能化为泡影。

几乎所有人都承认,LLM只是听起来合理,并非事实准确。在我们的常识中,一件事情看起来多厉害,和实际多有用,二者之间有天壤之别。我们无数次看到新闻媒体鼓吹说:“人工智能模型在标准化智商测试中得分已超过120,接近人类天才的水平。”也许真是这样,但误导性极强。智商126分的模型,可能无法察觉连儿童都能发现的伦理问题,当任务略微超出训练范围时,模型就会遭遇灾难性失败。这样的智商得分,可信度有多高?真称得上是天才吗?

虽然现实充满挑战,我们仍须保持乐观。前1000天可能只是人工智能的奠基阶段,未来1000天才是人工智能真正的爆发期,是价值变现时期,希望这样的猜测能够成真吧。(小刀)